OpenAI 正式发布了两款开放权重的大型语言模型:gpt-oss-120b 和 gpt-oss-20b。这是自 GPT-2 以来,OpenAI 时隔五年再次向公众开放模型权重,并首次在 Amazon Bedrock 与 SageMaker 平台同步上线。此次发布不仅回应了开发者社群和业界对开放模型的长期呼声,也体现了 OpenAI 在全球人工智能开源竞赛中态度的转变。

与早期的开源模型不同,gpt-oss 系列聚焦于推理能力和实际落地场景,强调在代码生成、多步逻辑推理、科学分析、数学问题等任务上的表现。尤其是 120b 参数的 gpt-oss-120b,能够在一块Nvidia 80GB GPU上运行,极大降低了高性能模型的使用门槛。20b 版本则可在消费级设备如笔记本电脑上部署,使个人开发者也能轻松上手。

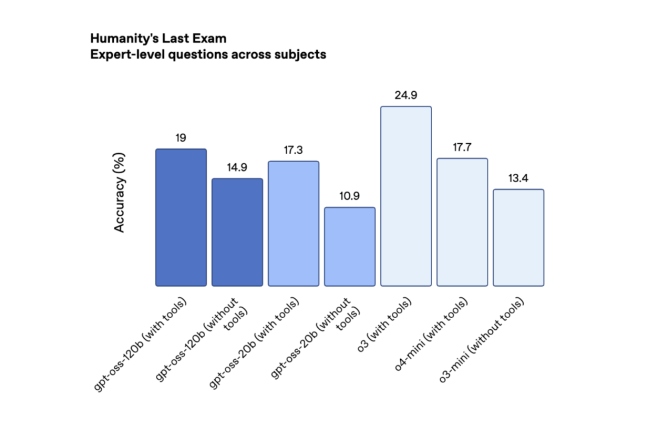

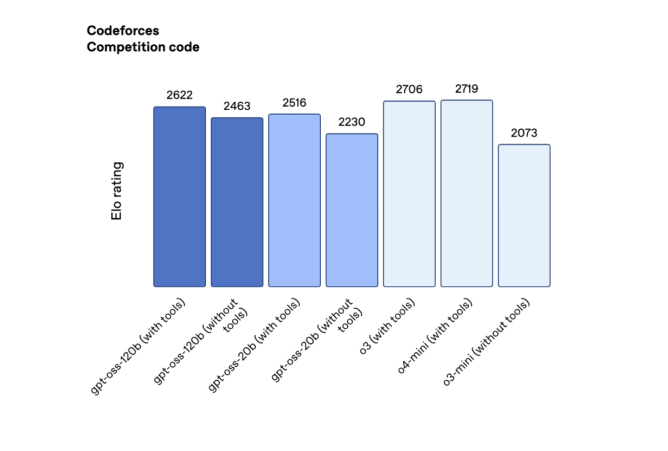

在性能上,根据 OpenAI 和第三方基准测试,gpt-oss-120b 在 Codeforces 等编程能力测试上超越了 DeepSeek R1 等开源竞品,仅次于 OpenAI 自家的 o3、o4-mini 等最新专有模型。在 Humanity’s Last Exam 等通用推理任务上,gpt-oss 系列也展现出领先的综合实力。不过,和更大规模的专有模型相比,开放权重模型在 “幻觉率” 上仍有提升空间。例如在 PersonQA 等知识准确性测试中,gpt-oss 系列的回答错误率高于 OpenAI 最新的闭源模型。这一现象也被 OpenAI 称之为 “模型规模的限制”,并非完全可控。

gpt-oss 系列采用了混合专家(Mixture-of-Experts, MoE)架构,每次仅激活部分子网络以提高效率和推理深度,但具体的路由机制等关键细节并未公开。OpenAI 强调本次开放只涉及已知的技术组件,未披露专有算法与训练方法,以避免知识产权泄露。这一策略平衡了技术共享与商业安全,也与 Meta、Mistral 等公司的做法趋同。

此次发布还 OpenAI 再次强调了他们对安全性的重视。OpenAI 不仅在训练和微调过程中加入了高强度的安全机制,还专门评估了模型在网络安全、生物和化学领域的潜在风险。即便如此,仍有业内观点认为,开放权重模型的可控性和可追溯性将成为行业持续关注的重点。

从应用层面看,gpt-oss 系列的到来极大丰富了云端 AI 模型的生态。通过 Amazon Bedrock 和 SageMaker,开发者和企业能够在安全、合规的环境下进行模型定制、评估和大规模部署。这一开放不仅有助于推动 AI 技术在科研、工业、金融、医疗等行业的创新应用,也为全球开发者提供了更多选择,开放权重模型有望成为未来通用人工智能基础设施的一部分。

OpenAI 此次选择 Apache 2.0 等宽松开源协议,允许企业级用户在不额外授权或支付费用的前提下进行商业化落地。但与部分 “完全开放源代码” 项目不同,OpenAI 仍未公布数据集详情。

总的来说,OpenAI 的 gpt-oss 系列既回应了开发者和市场对高性能开放模型的期待,也反映了大模型时代下,开源与专有、创新与安全之间复杂的动态平衡。未来,随着DeepSeek R2、Meta 新一代模型等竞品的陆续登场,开放权重模型的技术路线、产业标准与治理规范,或将成为通用人工智能领域持续演进的关键看点。

评论(0)