Deep Research Max 发布, Google 把自主研究智能体推向企业级工作流

Google DeepMind 发布了 Deep Research 和 Deep Research Max 两款新一代研究智能体。核心变化很直接。它们不再只是“帮你搜资料、做总结”的工具,而是开始承担长周期、可追溯、可接入私有数据源的企业研究流程。新版本基于 Gemini 3.1 Pro 构建,已经在 Gemini API 的付费公开预览中上线,后续也会进入 Google Cloud 。

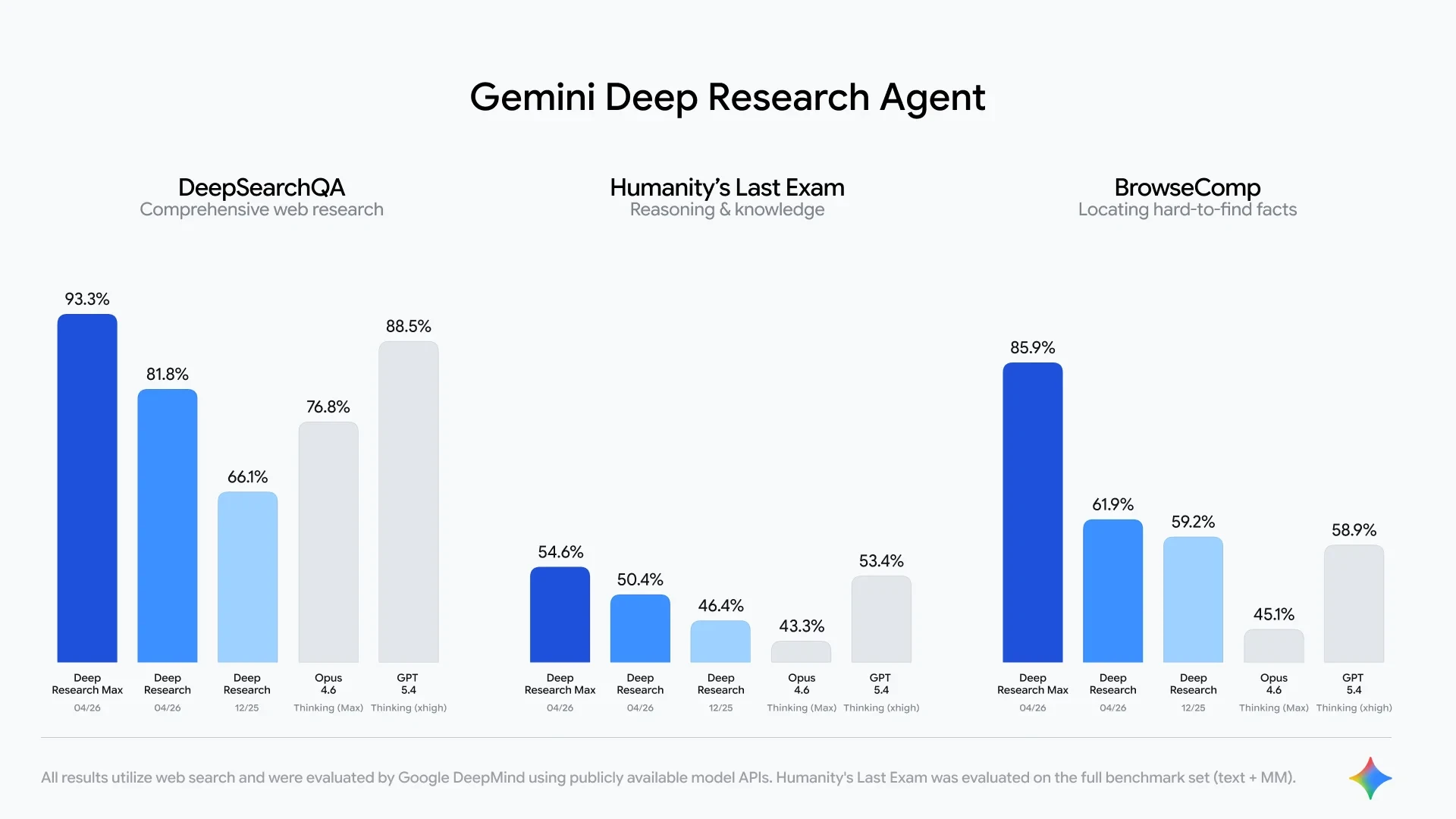

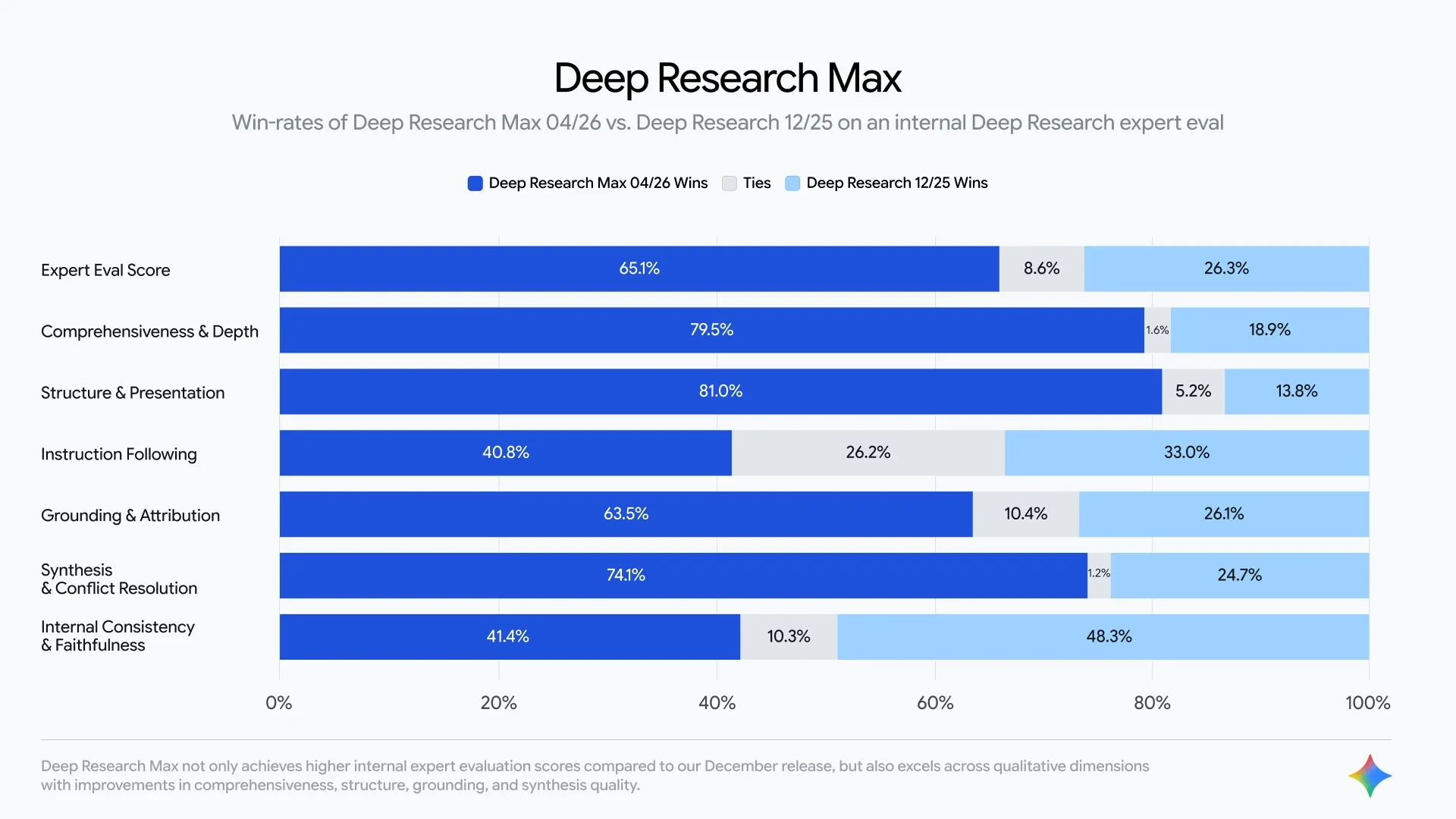

这次更新里,真正拉开差距的是 Deep Research Max 。 Google 的说法是,这一版本针对“完整性”和“分析质量”做了极限优化,会投入更长的测试时计算资源,反复执行推理、检索和修订,最终生成更深入的报告。它更适合异步、后台式任务,比如分析团队夜间批量生成尽调报告,第二天一早直接交付使用。相较之下,标准版 Deep Research 更强调速度、延迟和成本控制,瞄准的是直接嵌入交互式产品界面的实时研究场景。

Google 这次想表达的重点,其实不是“模型更强”这么简单,而是研究智能体的边界被重新定义了。过去,类似产品大多停留在开放网页搜索和文本摘要层面。现在, Deep Research 可以把开放网络、远程 MCP 、文件上传、已连接文件库混在同一条工作流里使用,也可以只选其中一部分。换句话说,它开始进入专业人士每天都会面对的“半封闭信息世界”。

其中最关键的能力,是对模型上下文协议 ( Model Context Protocol , MCP ) 的支持。借助 MCP ,开发者可以把 Deep Research 安全接入自定义数据源,以及金融、市场等专业数据流提供方。 Google 还提到,系统支持任意工具定义,这让 Deep Research 不再只是一个网页搜索器,而更像一个能在专用数据仓库里自主导航的研究智能体。对金融、生命科学、市场研究这类行业来说,这一步很现实。真正有价值的信息,很多时候并不在公共网页上,而在付费数据库、内部知识库、监管披露文件和研究文档里。

Google 还给这个智能体补上了一个过去常被忽视、但很影响交付质量的能力。它现在可以原生生成图表和信息图,并以内联 HTML 或 Nano Banana 的形式直接出现在报告中。也就是说,输出不再局限于文字说明,而是能把复杂的定性和定量数据直接转成接近演示文稿成品的可视化结果。这对分析师、投研团队和企业决策者很重要。很多研究任务真正耗时的,不只是找资料,而是把资料整理成能被快速阅读和呈现的格式。

从功能细节看, Google 正在把 Deep Research 打磨成一个更像“可控研究流程”的系统。用户可以在任务执行前先查看并修改智能体生成的研究计划,手动收紧或放大调查范围。它还能同时调用完整的 Gemini API 工具链,包括 Google Search 、远程 MCP 服务器、 URL Context 、代码执行和文件搜索。如果用户不想接入公网,还可以直接关闭网页访问,只在自有数据中完成检索。

输入侧也更灵活。 PDF 、 CSV 、图片、音频、视频都能作为研究依据接入,这让多模态研究不再只是展示能力,而是能真正把企业自己的材料作为分析地基。执行过程中,系统还支持实时流式输出,用户可以看到中间推理摘要,并实时接收文本和图片生成结果。对交互式产品界面来说,这比“等一份最终报告”要友好多了。

Google 对分析质量的表述也比以往更具体。按照官方介绍, Deep Research Max 相比去年 12 月版本会查阅更多来源,并更容易捕捉旧版本经常忽略的关键细节。训练重点之一,是让系统主动接触来源更广、立场可能相互冲突的信息,再在彼此矛盾的证据中做权衡,而不是只拼接共识观点。最终报告会更多引用美国证券交易委员会文件、开放获取的同行评审期刊等权威资料,并把密集、专业的技术内容转化为可执行、可交付的分析格式。

Google 也透露了落地合作方向。团队正在和金融及生命科学等高容错空间极小的行业客户合作,尤其在专业、强监管场景中推进部署。公开点名的合作方包括 FactSet 、 S&P Global 和 PitchBook 。三家公司正与 Google 一起设计各自的 MCP 服务器,目标是让共同客户把这些金融数据产品直接接入 Deep Research 驱动的工作流,快速完成背景信息收集和分析准备。

这背后还有一层更现实的意义。 Google 并不是在单独推出一个实验性研究工具,而是在把自家多个产品内部已经使用的自主研究基础设施,对外开放给开发者。官方明确提到, Deep Research 背后的能力已经服务于 Gemini App 、 NotebookLM 、 Google Search 和 Google Finance 等产品。对开发者和企业来说,这意味着它不是一套全新的边缘系统,而是站在 Google 现有规模化基础设施上的一层能力封装。

目前, Deep Research 和 Deep Research Max 已经通过 Gemini API 的付费层级,以公开预览形式开放,接入方式是 Interactions API 。 Google 表示,这两项能力很快也会面向 Google Cloud 上的初创公司和企业客户提供。

创艺洞察

这次更新真正有分量的,不是“研究智能体更会写报告”了,而是 Google 正在把研究这件事拆成标准化、可编排、可审计的生产流程。 MCP 负责接数据, Gemini 3.1 Pro 负责推理,原生图表负责交付,实时过程可视化负责建立信任。这套组合拳很像企业软件,而不再只是聊天机器人加搜索框。说白了,谁先把“研究”做成稳定的后台基础设施,谁就更有机会吃下下一轮高价值知识工作的入口。