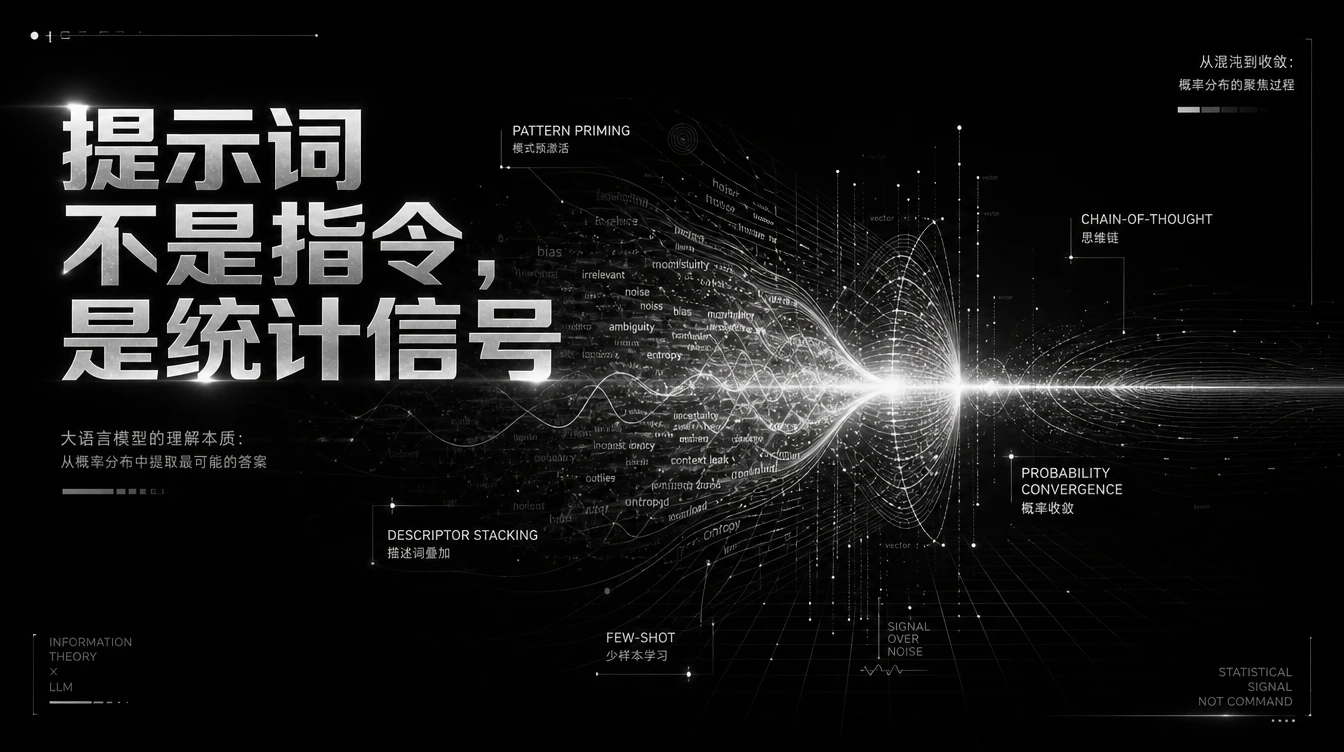

提示词不是指令,是统计信号。Pattern Priming,一种被低估的提示工程技巧。

5月初,AightBits 发表了一篇关于 Pattern Priming 的文章,提出了一个看似简单但极其深刻的观点:不要把提示词当指令,把它当成统计信号!

大多数人和模型交互时,直觉上把提示词理解为“指令”,告诉模型做什么,模型就去执行。但模型的底层机制不是理解意图,而是条件概率预测。你说“请客观总结”,模型不是在切换到“客观模式”,而是“客观”这个词在训练数据中大量出现在学术论文、政策报告等严谨文本中,模型的输出分布就被拉向了这类文本的风格。

所以,每个提示词镇长在做的都在微调条件概率!

Pattern Priming 的操作方法很具体。与其写“请客观总结这段内容”,不如写“请给出清晰、客观、基于事实、技术准确的总结。避免推测、偏见和说服性语言。聚焦于可验证的信息”。对人类来说这两句话意思差不多,但第二句里密集出现的“客观”“事实”“技术准确”、“可验证”在训练数据中大量出现在学术文本,等于用词汇的统计关联把模型推向更严谨的输出分布。

这跟 Few-Shot(给范例)和 Chain-of-Thought(要求逐步推理)不在同一个层面。Few-Shot 给的是结构模板,Chain-of-Thought 给的是推理路径,Pattern Priming 给的是风格信号。三者可以叠加,但机制完全不同。

冗余不是啰嗦,是 Descriptor Stacking

作者提了一个反直觉的结论:在提示词里重复近义词不是啰嗦。说“客观、批判、详实、事实性、技术上准确”看起来在说同一件事,但每个词都在微调条件概率的方向。这叫 descriptor stacking 用密集的近义修饰词把输出的权重叠加起来。

文章还讨论了长对话中的 context drift(把会话当一次性用品) 问题。聊了十几轮后模型行为开始偏离初始设定,不是因为模型“忘了”,而是因为前面生成的 token 在持续影响后续生成的条件概率。作者的方案很干脆:开新会话,把关键信息压缩后带入,而不是试图用更多指令把模型拽回来。

如果你想让模型输出像同行评审,不要写“请像审稿人一样回复”,而是直接用审稿人的语气和词汇来描述任务。模型不是在“扮演”审稿人,它是在续写看起来像审稿人写过的文本。

文章链接:Pattern Priming in Prompting: How to Shape LLM Output with Statistical Cues