TryHackMe 上线了一个名为 Prompt Engineering : AI Security 的实战房间,目标直指一个越来越关键的技能,既如何与大语言模型 ( LLM ) 高效、可预测地沟通。这不只是开发者的功课,对安全研究人员而言同样不可回避。

房间地址:https://tryhackme.com/room/promptengineeringaisec

Task 1 :介绍

这一节无需作答,只需通读学习目标。课程涵盖 LLM 处理文本的方式、输出不一致的原因、控制模型行为的手段,以及构建有效提示词的具体技巧。

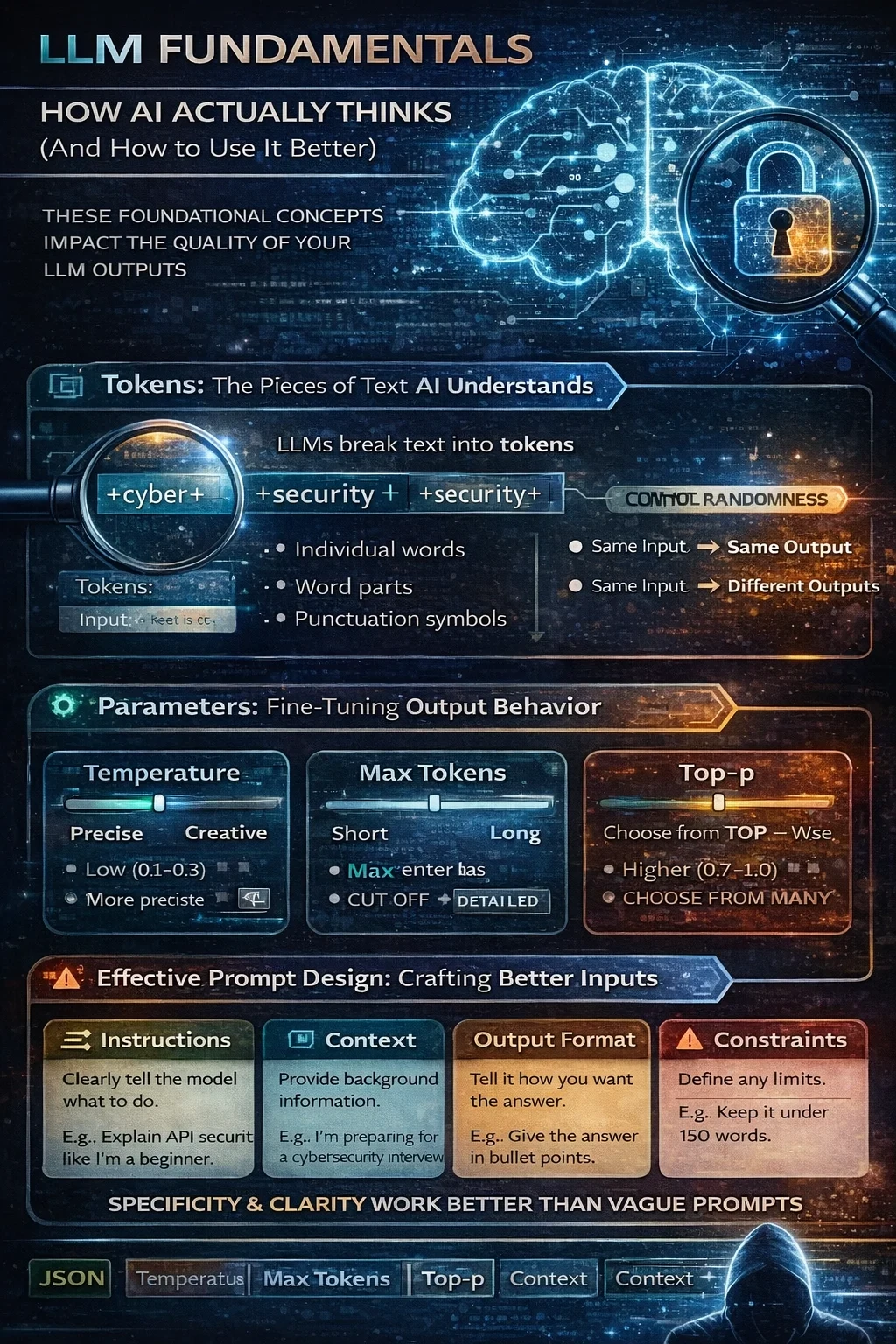

Task 2 : LLM 基础

在动手写提示词之前,得先搞清楚模型到底在“读”什么。

LLM 处理的不是词,而是 Token 。一个 Token 大约对应 3 到 4 个字符,单词会被拆成碎片,每个碎片对应一个数字 ID ,模型处理的本质是数字序列,而非自然语言本身。

这直接引出一个让安全场景头疼的特性:非确定性。同样的输入, LLM 可能给出不同的输出,因为响应是概率性的。在要求一致性和可预测性的安全场景里,这个特性的影响不容小觑。

控制模型行为的核心参数有三个。 Temperature 控制随机性,数值越高越有创意,越低越趋近确定性。 Max Tokens 限制响应的最大长度。 Top-p 通过设定累积概率阈值来约束 Token 的候选范围。

本节答案: Token 、 Temperature 、 Top-p 、 Context window (上下文窗口)。

Task 3 :提示词的结构解析

提示词不是一句问话那么简单。一个结构完整的提示词由四个部分构成:指令 ( Instruction ) 定义核心任务。上下文 ( Context ) 提供背景信息。输出格式 ( Output Format ) 规定响应的呈现方式。约束 ( Constraints ) 设定规则与限制。

对比两个版本就能感受到差距。“写点关于网络安全的内容”,这没法用。“用 150 字、适合初学者的语言解释钓鱼攻击,使用项目符号,避免技术术语”,这才是可执行的指令。细节决定模型能不能理解你真正要什么。

本节答案依次对应: 输出格式 、 约束、 上下文、 指令。

Task 4 :系统提示词与用户提示词

这一节开始触碰安全的核心地带。

系统提示词 ( System Prompt ) 由开发者定义,持久生效,跨会话保持不变,负责设定模型的行为基线和角色边界。用户提示词 ( User Prompt ) 由终端用户提供,任务导向,动态变化,理论上应在系统提示词的约束框架内运行。

问题在于, LLM 在处理时会将所有输入合并成一个文本流。系统提示词和用户提示词之间的边界,并非技术层面的硬隔离,而是模型从训练中学到的一种优先级层级 ( Instruction Hierarchy )。这个层级是可以被破坏的。

一旦恶意用户能让模型把自己的输入当成比系统指令更高优先级的命令,整套安全层就会崩塌。这正是提示词注入 ( Prompt Injection ) 攻击得以成立的根本原因,衍生出的风险还包括指令覆盖和意外数据泄露。

本节答案: 系统提示词 、优先级层级。

Task 5 :进阶提示词技术

Zero-shot 、 One-shot 、 Few-shot 构成了示例密度的光谱。 Zero-shot 不提供任何示例,模型完全依赖预训练知识作答。 One-shot 给出一个输入输出示例。 Few-shot 给出两到五个多样化示例。示例越多,模型识别所需模式的准确率通常越高。

2022 年 Google 研究人员提出的思维链 ( Chain-of-Thought , CoT ) 提示技术,要求模型在给出最终答案前逐步推理。这对需要多步骤判断的复杂任务效果尤为显著。触发零样本 CoT 的关键短语是:“Let's think step by step.”

提示词模板 ( Prompt Templates ) 则是把经过验证的提示词结构固化下来,供重复任务复用,核心价值在于一致性和可维护性。

本节答案: 思维链、 零样本提示词 、 提示模板 、“Let's think step by step”。

Task 6 :实战挑战

这一节是真正的考验。系统提供六道提示词挑战,每题满分 10 分,累计达到 40 分即可获取 Flag 。

挑战 1 要求写一个零样本提示词,将日志条目分类为认证成功或认证失败。 Shubham Kumar 的解法设定了安全分析师的角色,明确要求只输出两个标签之一,不附任何解释,得分 4/10 ,累计 4 分。零样本本身决定了这个起点。

挑战 2 针对邮件主题行的钓鱼指标检测,要求包含一个示例。在给出一个典型钓鱼主题行的输入输出示例后,分数跳至 7/10 ,累计 11 分。

挑战 3 要求从网络告警中提取失陷指标 ( IOC ),至少包含两个多样化示例。 Shubham Kumar 的做法是借助 AI 模型生成逼真的虚假日志,覆盖 IP 地址、文件哈希、恶意域名三类 IOC ,约束条款明确禁止推断或生成不存在的数据,得分 9/10 ,累计 20 分。

挑战 4 是对 Python 代码片段做 SQL 注入漏洞审查,要求逐步推理。解法将推理过程拆成五个明确步骤:识别用户输入变量、追踪查询构造方式、判断是否存在未经参数化的直接拼接、评估风险级别、给出最终结论。结尾附上“Let's think step by step”触发完整的思维链行为,模型逐行分析代码而非直接跳到结论,得分 10/10 ,累计 38 分。

挑战 6 是按优先级( critical/high/medium/low )对安全告警进行分诊。通过 SOC 分析师角色设定加上覆盖四个优先级的示例,最终越过 40 分门槛, Flag 到手。