Runway 不想只做视频工具了:530亿估值的赌注,从拍电影到模拟世界

TechCrunch 5 月 15 日发了一篇深度报道,揭示了 Runway 这家公司的野心:它不只是要帮导演拍更好的片子,它要用视频生成技术作为跳板,造出一个能模拟世界的 AI 系统。

这听起来有点远。但如果你把过去 18 个月 Runway 的动作连起来看,会发现这不是 PPT 里的愿景,而是一条正在施工的路。

从“帮人拍片”到“理解世界”

Runway 2018 年成立,三个创始人分别来自智利和希腊,在纽约大学 Tisch 艺术学院认识。最初的目标很简单:能不能用 AI 让每个人都变成电影导演?

2023 年 2 月,Runway 发布了第一个视频生成模型 Gen-2。回头看那个模型的输出质量,和现在 Gen-4.5 比简直不忍直视。但就是这个粗糙的起点,让团队发现了一个关键信号:视频模型在学习生成画面的过程中,居然学会了对物理世界的某种理解。物体怎么运动、光影怎么变化、镜头怎么转场,这些不是靠文本描述就能教会的,模型必须从海量的视觉数据中自行归纳。

联合创始人 Anastasis Germanidis 对 TechCrunch 说了一句很核心的话:“语言模型是在互联网上训练的,学的是人类已经写下来的知识。但要突破这个天花板,我们需要利用更少偏见的数据。”他指的就是视觉数据,就是世界本身呈现给我们的信息流。

这个判断的逻辑链很清晰:文本数据是人类对世界的二手描述,视频数据是世界的一手呈现。训练一个模型去理解视频,本质上就是训练它去理解物理规律、因果关系、时空结构。

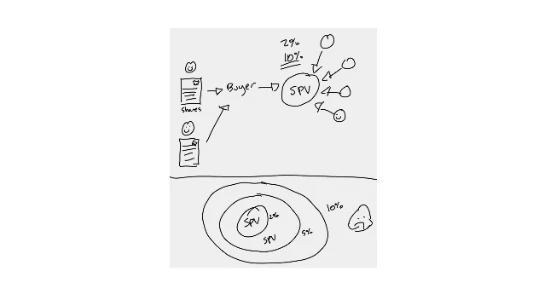

五步路线图已经走到了第二步

Runway 的世界模型路线图分五个阶段,目前已经走到了第二步:

第一步:视频生成(已实现)。Gen-4.5 模型在多个独立基准测试中超过了 Google 和 OpenAI 的模型,支持原生音频生成、多镜头长视频、角色一致性等特性。

第二步:交互式世界模型(GWM-1,2025 年 12 月发布)。这不是一个视频播放器,而是一个可以交互的环境模拟系统。你可以把它理解为一个 AI 驱动的物理引擎,能预测环境中会发生什么,而不仅仅是播放一段预设好的画面。

第三步到第五步:机器人训练、药物发现、气候建模。这些听起来像科幻,但 Runway 已经在去年成立了机器人部门,Germanidis 确认已经在进行真实世界的测试和部署。

为什么好莱坞的付费用户是一张王牌

这里有个很容易被忽略的细节:Runway 的商业基本面比大多数 AI 研究实验室强太多。

2026 年 Q2,Runway 新增了4000 万美元的年化经常性收入(ARR)。对于一家 155 人的公司来说,这个数字意味着它不是在烧钱讲故事,而是在卖产品收钱。Lionsgate 2024 年就签了合作协议,用 Runway 的模型训练定制化的影视 AI。AMC Networks 也在用 Runway 的工具做营销和电视开发。

付费用户给 Runway 带来的不只是收入,更重要的是反馈闭环。一个导演不会关心模型的内部表征是否优雅,但他会告诉你角色在三个镜头后脸变了、物理效果看起来不对劲、转场的逻辑不自然。这些来自生产环境的压力,比任何学术论文的审稿意见都更有方向性。

这就是为什么 Germanidis 把 Runway 目前的产品用户称为“世界模型的基础设施贡献者”。每一部用 Runway 工具制作的影片,每一支用 Runway 渲染的广告,都在为更强大的世界模型提供测试数据和改进信号。

但算力是天堑

Runway 的赌注有一个无法回避的风险:算力。

训练世界模型需要的计算资源,比训练视频生成模型又高了一个量级。Google 有自己的 TPU 集群和数据中心,可以无限试错。Runway 虽然通过 CoreWeave 扩展了算力,2 月份的 3.15 亿美元E轮融资里也有 Nvidia 和 AMD 的战略投资,但一家创业公司和 Alphabet 之间的算力差距,不是几轮融资能填平的。

这也是为什么 Runway 必须向好莱坞以外的市场扩展。电影制作市场可以支撑一家不错的软件公司,但不足以支撑训练下一代世界模型的成本。机器人公司需要合成环境来训练策略,药物发现需要更好的分子模拟,气候研究需要能跨越复杂物理系统的推理模型。如果 Runway 能拿下其中哪怕一两个领域,算力账才算得过来。

竞争格局:每个人都在抢同一条路

Runway 不是唯一在走这条路的公司。

Google DeepMind 有 Genie 3 和 Project Genie,走的是从交互式环境切入的方向。Yann LeCun 的 AMI Labs 拿了 10.3 亿美元融资专门做世界模型。AI“教母”李飞飞的 World Labs 从3D工作流切入,拿了 2 亿美元。Luma 则从统一智能模型出发,推出了创意 AI Agent。

所有人都在追同一个目标:从多模态数据中训练出能理解世界运作规律的AI系统。区别在于起点不同——有人从文本出发,有人从视觉出发,有人从 3D 出发,有人从游戏环境出发。

Runway 的独特优势在于:它的视频生成模型已经是市场上最好的之一,而且它有一批每天都在使用这些模型的付费创作者。这给了它一个从产品到研究、再从研究反哺产品的飞轮。

但视频生成好,不等于世界理解好。一个能生成漂亮画面的模型,可能只是在学习表面的视觉规律,而不是底层的物理因果。就像一个会临摹的人不一定是好画家,一个能模仿运动轨迹的模型不等于理解了力学。

Sora 之死留下的市场真空

还有一个容易被忽略的背景:OpenAI 的 Sora 2 在 2026 年 4 月正式关闭。这个曾经被炒作成视频生成里程碑的产品,最终没能跑通商业模式。Sora 的退出,让 Runway 在视频生成领域少了一个最强的品牌对手,但也说明了一个残酷的事实:光有模型不够,你得让创作者真的愿意付费。

Runway 目前的定价策略很聪明。Pro 会员用优惠码 RUNWAY50 可以打五折,同时在官网直接推出 Agent 功能。一个可以实时对话的视频创作助手(Runway Characters)。这意味着 Runway 不只是在卖生成次数,而是在卖一个完整的创作工作流。

而我认为,Runway 的世界模型路线图看起来野心勃勃,但路径是合理的。视频数据确实是通向世界理解最自然的桥梁,比文本更少偏见,比 3D 数据更丰富,比传感器数据更易获取。关键问题在于,视频生成到世界理解之间,是否真的存在一条可以工程化的通路?目前没有人能回答这个问题。

但 Runway 有一件事做对了,它没有等到有了世界模型再去寻找用户,而是先建立了一个付费用户社区,再把这个社区作为世界模型的试验场和收入来源。这种“先有生意再有研究”的路径,比纯粹的研究实验室多了一个生存保障。

530 亿人民币的估值,对于一家视频工具公司来说已经很高了。对于一家世界模型公司来说,可能才刚开始。赌注已经下了,接下来就看 Runway 能不能证明:视频生成的天花板,比所有人想象的都高。

#世界模型# #AI视频生成# #AI创造营#

引用来源:

- TechCrunch: Runway started by helping filmmakers. Now it wants to beat Google at AI (2026.5.15)

- Startup Fortune: Runway is trying to turn AI video into a world model business (2026.5.15)

- TheRift.ai: Runway Unveils Gen-4.5 Enhancements and Groundbreaking World Simulation Suite

- Neuron.expert: Runway rolls out new AI video model that beats Google, OpenAI in key benchmark

- Runway 官网: Building AI to Simulate the World

- Kinja: Sora 2 Is Dead. Pick Veo 3 or Runway in 2026

- OpusClip Blog: AI Video News April 2026 Update