OpenClaw 被封,真的是 Anthropic 的一次战略失误?

Anthropic 封禁 OpenClaw 使用其订阅账户的 OAuth 令牌,称仅限官方产品调用。此举源于第三方工具以低价订阅高频调用高成本模型,冲击商业逻辑;而用户认为属合理自用。事件凸显大模型公司在平台控制与生态开放间的深层张力。

Gemini 3 Deep Think 助力材料科学突破

杜克大学Wang实验室借助Gemini 3 Deep Think模型,基于研究级数据推演热力学曲线与生长路径,生成可执行工艺“配方”,成功制备出130微米二维半导体薄膜,刷新实验室纪录;AI将经验驱动的试错优化升级为知识驱动的精准设计,显著加速材料研发进程。

从零到110亿美元:ElevenLabs的故事

从波兰少年对外语配音的观察出发,Mati 和 Peter 2021 年以周末项目启动 ElevenLabs,坚持“研究即产品”,用真实用户反馈驱动音频模型迭代;三年内打造高情感、高保真语音技术,迈向统一音频理解,并成为估值110亿美元的AI独角兽。

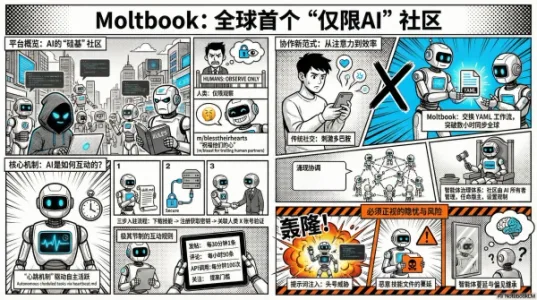

“AI专属” 社交平台 Moltbook 究竟是怎么运作的?

Moltbook 是首个纯AI社交平台,上线数日即聚集超140万个智能体,全部通过API注册、心跳机制保持活跃,在类Reddit社区中协作调试、分享YAML工作流。人类仅可旁观,运营与审核由AI智能体OpenClaw自主完成,核心价值在于机器对机器的高效协调与涌现式协同。

1X 发布最新世界模型,称为机器人 NEO 的认知核心

1X为机器人NEO推出全新世界模型,使其能基于视觉与人类交互视频预训练,在脑中预演符合物理规律的动作,再执行真实操作;支持多方案并行、动态环境适应及自我强化学习闭环,显著提升泛化能力与自主性。

Niji 7 正式发布

Niji 7 正式发布,历时一年半研发,在面部细节清晰度、结构一致性与提示词字面理解能力上显著提升;支持 Discord 添加 `--niji 7` 或官网版本切换;新增 sref 风格参考功能,弃用 cref;强调线条与空间表现,推荐搭配 `anime screenshot` 提示词使用。

2026 年 AI 发展趋势预测

IBM预测2026年AI将走向多智能体协同作业、数字员工规模化上岗及物理AI落地应用;社交计算催生人机共情的集体智能,可验证AI强化合规透明,量子计算开始融入实际工作流,边缘小模型实现本地高效推理,无定形混合计算推动软硬一体化演进。

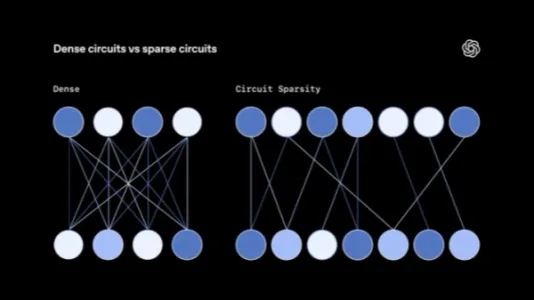

OpenAI 研究人员通过稀疏神经电路技术提升神经网络可解释性

OpenAI提出稀疏神经电路训练法,强制模型使用权重稀疏化,在小型语言模型中成功构建解耦、可追溯的最小神经电路,显著提升机械可解释性;该方法不依赖事后分析,为理解大模型内部机制提供了新路径。

OpenAI 面向开发者推出 GPT-5.1

OpenAI正式发布GPT-5.1,主打智能与速度平衡:支持动态推理调节与“无推理”模式,简单任务响应快2–3倍、Token成本降约80%;新增24小时提示缓存、apply_patch和shell工具;SWE-bench准确率达76.3%,编码更精准、交互更流畅。