拥有 25 亿参数的 Stable Diffusion 3.5 Medium 如期发布

Stable Diffusion 3.5 Medium 正式发布,25亿参数,免费商用。仅需9.9GB显存即可高效运行,兼容主流消费级GPU,支持多分辨率输出,在提示理解与图像质量上优于同规模模型,适合初创团队与个人创作者落地使用。

Haiper 发布 2.0 可以制作 30 秒 4K 高清视频

Haiper 2.0上线,支持生成最长30秒、4K分辨率60FPS的高清视频;新增舞蹈、人像、梗图等垂直场景模板,并在生成过程中集成背景去除、光线优化与镜头调整等精细化控制能力。

Runway Act-One 和 可灵 + LivePortrait 方案对比

Runway Act-One 仅支持面部表情迁移,无法处理肢体动作与环境变化;而可灵+LivePortrait(免费)方案在非特写镜头中泛化能力更强,能更好应对多角度、多场景的视频驱动需求,实用性更优。

结合目前主流的绘画模型的设计工具:Gamma

Gamma 新增集成 Flux Pro 1.1、Imagen 3、Ideogram 2 和 DALL·E 3 等主流 AI 绘画模型,让网站与 PPT 制作用户可直接调用多种图像生成能力。这标志着生成式 AI 正加速从底层技术走向设计类工具的深度实用化。

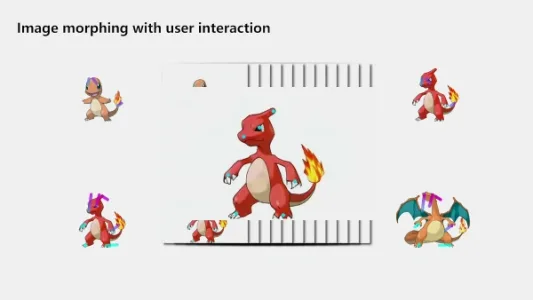

Framer:可设置运动轨迹的视频插帧技术

Framer是一款交互式视频插帧工具,支持手动设置关键点运动轨迹,精准控制两帧间的局部形变与过渡;也提供“自动驾驶”模式自动估计关键点并优化轨迹。适用于图像变形、延时摄影、卡通插值等场景,兼顾创意控制与使用便捷性。

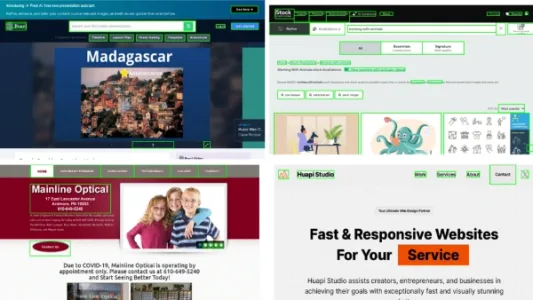

微软发布最新用户界面解析模型:OmniParser

微软推出OmniParser,可将UI截图精准解析为结构化元素,显著提升GPT-4V等视觉语言模型对界面组件、图标功能及可交互区域的理解能力;基于6.7万截图与7000图标描述对训练,在SeeClick等基准测试中超越GPT-4V基线,亦可作为插件增强Phi-3.5-V、Llama-3.2-V等模型的UI理解性能。

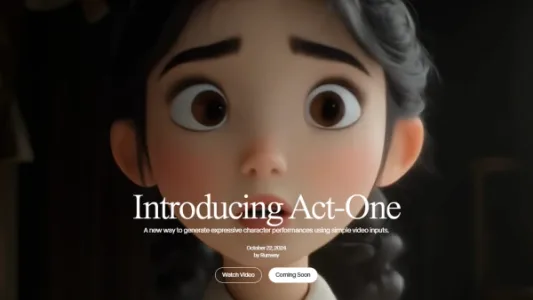

Runway Act-One 面部表情捕捉工具介绍

Runway推出Act-One面部表情捕捉工具,基于Gen-3 Alpha模型,仅需普通相机拍摄的单人表演视频,即可高保真还原视线、微表情与情感节奏,并驱动多角色动画生成。无需动捕设备或复杂绑定,支持跨角色复用表演、声音变换及多轮对话场景创作,现已面向资深用户开放。

Canva 可画的十项魔法(AI)新功能

Canva 可画上线十项AI新功能,涵盖文生图、智能扩图、主体抠图与局部编辑、一键格式转换与翻译、AI生成PPT/视频/社媒帖、图像变形及路径动画等,大幅降低设计门槛,让非专业用户也能高效产出高质量视觉内容。

Midjourney 推出全新图像编辑器

Midjourney上线全新图像编辑器,首次支持上传并编辑非AI生成的自有图片,提供扩展、裁剪、重着色、元素增删等操作;新增“纹理更换模式”,可智能重置光照、材质与表面纹理;所有编辑均通过文本提示+区域选择控制,兼容风格/角色参考;V2 AI监督系统正测试中。