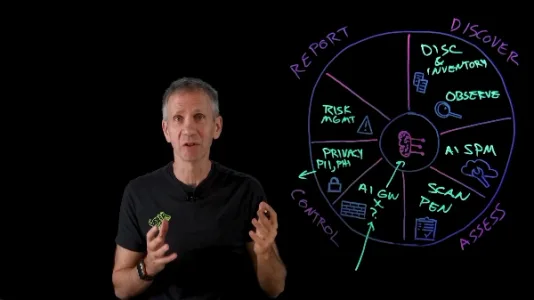

如何为 AI 系统打造安全 “护城河”

IBM提出“甜甜圈”AI安全体系,以“发现、评估、控制、报告”四环闭环,覆盖影子AI识别、动态风险评估、输入输出与权限管控,并通过可视化仪表盘和合规报告实现透明治理,强调安全需随AI演进持续迭代。

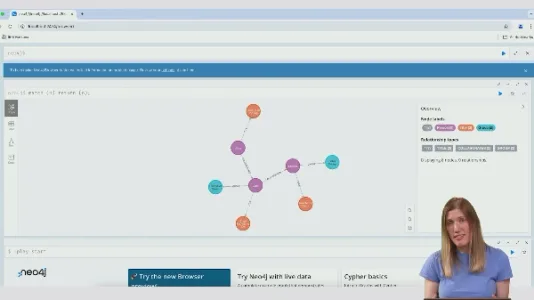

GraphRAG 知识图谱赋能智能检索:走向更强大的信息理解与推理

GraphRAG用知识图谱替代向量数据库,通过节点-边结构显式建模实体关系,显著提升复杂推理、全局归纳与多层聚合能力;大模型可自动将自然语言转为Cypher查询并解释结果,增强可解释性与检索多样性。

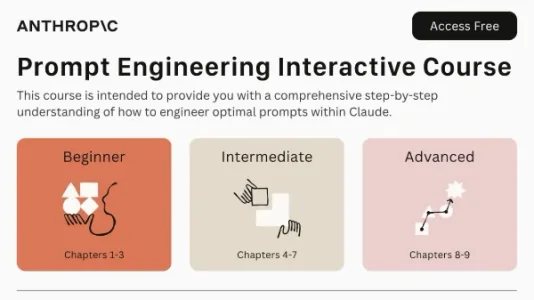

免费 Anthropic 交互式提示工程(Prompt Engineering)教程

Anthropic 推出免费交互式提示工程教程,含9个渐进章节,聚焦 Claude(尤其 Haiku 模型)的提示设计:从基础结构、角色设定到避免幻觉、行业场景应用及提示链等,每章配练习与实时调试的“示例操练区”,附参考答案。

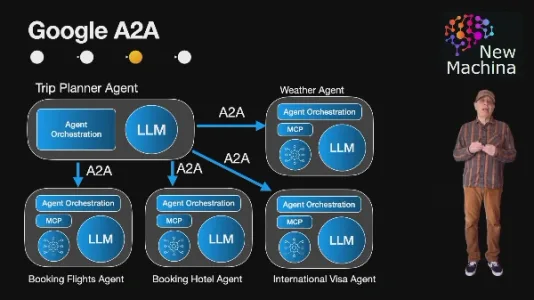

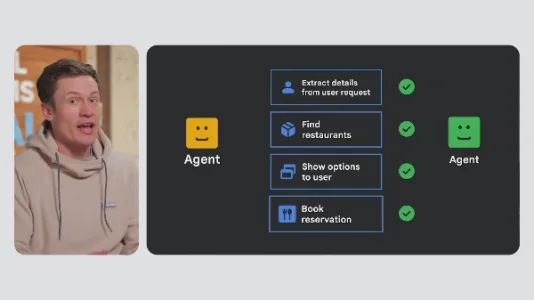

什么是 Google A2A 协议

Google推出的A2A协议,旨在让不同团队、厂商的智能体通过标准化JSON消息自动协作,实现能力共享与任务流转,推动智能体从“单兵作战”走向“团队合作”。它不替代MCP,而是与其互补:MCP负责智能体与模型/工具的集成,A2A专注智能体之间的协同。Salesforce、SAP等已加入支持。

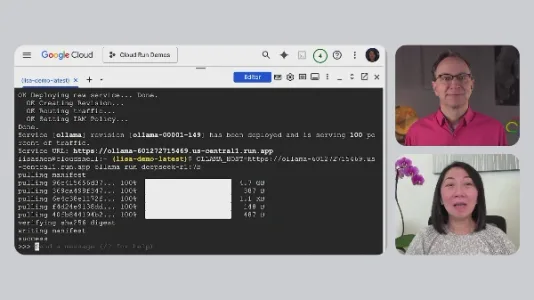

如何通过 Cloud Run 一键部署 DeepSeek

Google Cloud 工程师演示了用 Cloud Run 三步部署 DeepSeek 的方法:支持 GPU 实例、自动扩缩容(可缩至零),模型可按需加载或预置进镜像。无需运维底层资源,开发者能快速上线大模型服务,兼顾弹性、成本与易用性。

如何在 AI 系统开发过程中驾驭非确定性

AI系统固有的非确定性无需消除,而应科学管理。文章指出,盲目调低温度等参数会损害创造力;关键在于明确质量边界、分阶段评估输出、强化全链路日志、适时引入人工干预,并沿用异常处理、兜底机制等成熟工程实践。

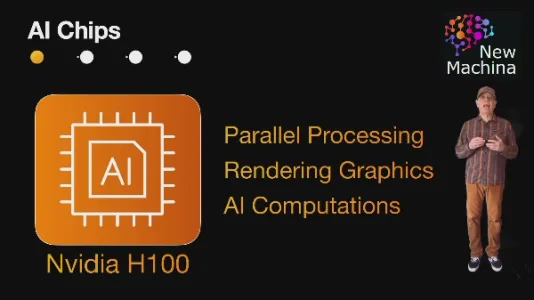

什么是 AI 芯片?

AI芯片是专为矩阵/张量运算优化的处理器,区别于通用CPU,以高并行性支撑深度学习训练与推理。GPU最早被用于AI计算,TPU、NPU等专用架构随后兴起。科技巨头与初创公司加速自研,推动AI算力从云端向手机、汽车等边缘设备下沉。

Freepik 图像编辑 AI 助手

Freepik 新推图像编辑 AI 助手,支持用自然语言指令直接修改图片,还能在画布上添加图示与文字备注,让调整更精准、操作更直观,适合设计师快速迭代视觉方案。

如何通过 Freepik 制作 AI 网红

用 Freepik 搭配 Flux 1.0 生成高细节 AI 网红形象,再通过可灵 1.6 Pro 转为口型同步短视频,支持自定义声音与台词。示例涵盖复古厨房自拍、POV 动态镜头等场景,兼顾人物表情、动作与环境真实感,适合低成本打造专业级 AI 内容。