LLM 量化:在性能与效率之间寻找平衡

LLM量化通过将参数压缩至16/8/4/2位整数,大幅降低存储与计算开销,让大模型得以在手机、笔记本等普通设备本地运行,兼顾效率与隐私。但精度下降是主要代价,GPTQ、AWQ等新技术正尝试在速度与准确率间找到更好平衡。

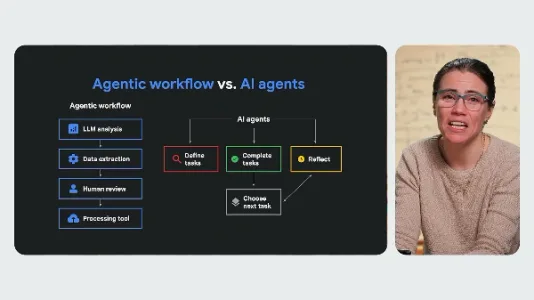

智能体还是智能体工作流

智能体强调大模型驱动的自主决策与非确定性执行,适合复杂灵活任务;智能体工作流则将AI能力嵌入预设流程,强调确定性、可控性与人工干预,更适配需稳定输出的业务场景。二者本质是自主性与可控性的权衡。

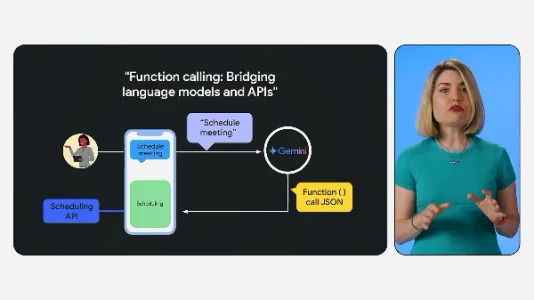

Gemini API 函数调用:连接 AI 与现实世界的桥梁

Gemini API 函数调用让模型能将自然语言(如“预订下周二下午3点会议室”)自动转为结构化指令,调用外部API执行真实任务;开发者只需预定义函数声明,执行由后端完成,支持多轮对话与灵活扩展,是大模型连接现实工具的关键能力。

半监督学习:AI训练的成本优化之道

半监督学习用少量标注数据+大量未标注数据训练AI,显著降低人工标注成本。通过伪标签、聚类、主动学习等技术,模型能自主挖掘数据规律,提升泛化能力、缓解过拟合,更接近人类“观察—归纳”的学习方式。

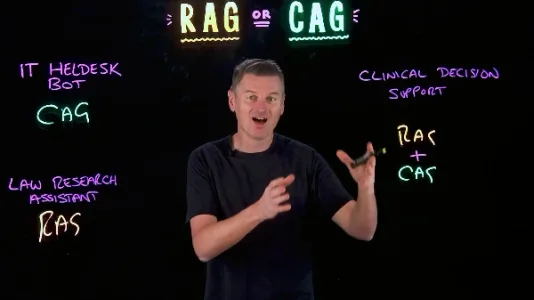

RAG & CAG:LLM 知识增强的两种路径选择

RAG按需检索外部知识,支持海量数据与实时更新;CAG预加载知识至上下文,响应快但受长度限制。二者并非互斥,在临床决策等复杂场景中可协同使用:RAG调取病历,CAG保障对话连贯。它们代表了知识组织的两种范式,也引发对AI时代知识本质的思考。

如何通过 RenderNet 为自己的商品制作视频广告

RenderNet 新增产品图片功能,支持上传真实商品图并智能抠图、缩放旋转,再自然融入 AI 生成或自选背景;一键调用内置 Runway 模型(或接入可灵、海螺等)生成高质量视频广告,专为电商营销优化。

开源自动化智能体工具 OpenManus 安装教程

OpenManus 是 Manus 的开源平替,GitHub 星标超3万,支持网页分析、SEO报告等核心功能,可免费本地部署。基于 Python,集成 browser-use 等工具,由多个协同智能体组成,目前仅终端运行,需通过 Conda 配置环境并填入 API 密钥后使用。

如何使用 Gemma 3 本地部署免费的深度研究 AI 助手

Google推出开源大模型Gemma 3(1B/4B/12B/27B四版本),支持多模态、12万token上下文及140种语言;4B/12B版可在MacBook Pro M2本地流畅运行,结合Ollama与LangChain,零成本搭建私有深度研究AI助手,擅长结构化输出与专业任务。

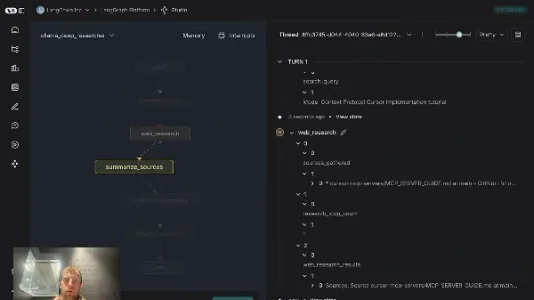

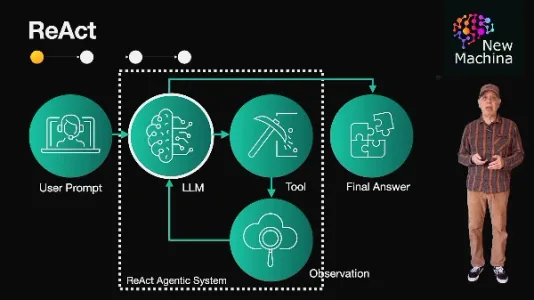

深入解析 LangGraph 智能体开发工作流:从概念到实践

LangGraph 通过图结构实现 ReAct 智能体工作流,让 LLM 能动态调用 NOAA 浮标 API 获取实时海洋天气数据。示例中,模型自主推理浮标 ID 并调用工具,展现“推理+行动”能力,代码简洁、扩展性强,为金融、医疗等需实时数据的场景提供可落地的智能体开发路径。