如何使用 AI 制作教育电视动画

AIGC达人Umesh仅用90分钟,借助ChatGPT、Story Illustrator、海螺AI、ElevenLabs和InShot等工具,完成教学动画《男孩和女孩》全流程制作——从脚本、分镜、图像生成到动画合成、配音与剪辑,效果接近《爱探险的朵拉》,为教育内容创作者提供了高效可行的AI制作范式。

AI MV 《Love You More》制作流程介绍

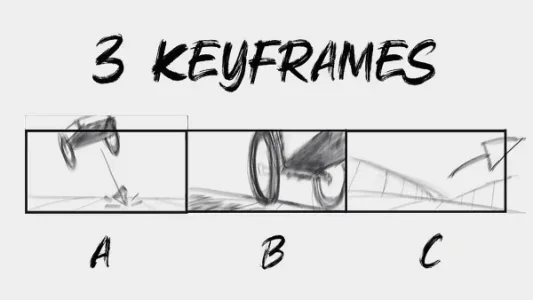

DoorBrother团队耗时两个月,以AI为创作核心,为Snoop Dogg打造AI音乐视频《Love You More》。他们担任AI“中间人”,主导分镜设计,融合可灵、Runway、Luma等工具的关键帧技术,探索AI视频工业化落地的可行路径。

如何通过可灵自定义模型扮演历史人物

TechHalla 利用可灵自定义模型,通过精准提示词稳定生成史前人类、哥伦布、维京战士、贝多芬等历史人物视频,统一形象、神态与场景氛围,在文生视频中实现高一致性历史角色演绎。

如何让 AI 制作的人物对话表现的自然

AI创作者MetaPuppet为提升可灵v1.5人物对话自然度,摸索出一套实用流程:先确保人脸稳定、光线充足;再将对话分段为5秒片段做口型同步;用Runway超慢动作(0.5倍速)插帧增帧率,最后在Pr中2倍速还原并精准对齐原音频,显著改善流畅度与真实感。

如何通过 Runway Gen-3 制作酷炫的弹跳视频

AIGC达人Always Generating用50秒演示:借助Runway Gen-3 Alpha的高级镜头控制,轻松生成富有节奏感与动态张力的弹跳效果视频,适合想快速上手AI视频创作的新手。

Runway Gen-3 Alpha 镜头控制极简教程

Runway Gen-3 Alpha 新增镜头控制功能,支持用简明指令调节推拉、摇移、焦距与构图。Runway 学院推出极简教程,零基础用户也能快速掌握,提升视频生成的镜头表现力。

Runway 面部表情捕捉 Act-One 使用教程

Runway新推Act-One面部表情捕捉工具,上传一段带丰富表情的自拍视频+一张人物参考图,即可自动生成高还原度、富有表现力的驱动视频,操作极简,适合数字人动画快速制作。

Midjouney 纹理重绘结合可灵制作创意视频

Midjourney纹理重绘可在保持主体轮廓前提下替换表面质感,配合可灵生成首尾帧过渡视频。四组案例展示墨线成花、手掌化岛、立方体融为巧克力蛋糕、战士蜕变为青铜雕像,全程依赖精准提示词实现形态与材质的诗意转化。

如何通过 Krea.ai 视频延长功能制作好玩的特效视频

Krea.ai 新增视频延长功能,支持上传实拍视频后,基于尾帧与文本提示(如“水晶球弹出并被手抓住”),调用 Runway、可灵、海螺或 Luma 四大模型生成最多5秒的无缝特效延伸内容,轻松为实景视频添加创意特效。