美国一家上诉法院的裁决与今年 3 月另一家下级法院的判决产生了冲突,这使得外界对美国军方如何使用人工智能公司 Anthropic 旗下 Claude 模型的疑问变得更加扑朔迷离。

华盛顿特区一家上诉法院周三裁定, Anthropic“未能满足撤销五角大楼对其施加的供应链风险认定所需达到的严格条件”。这一判决与上月旧金山一名下级法院法官作出的裁决相互矛盾,目前尚不清楚这两份相互冲突的初步裁定将如何得到解决。

美国政府依据两项不同的供应链相关法律对 Anthropic 实施了制裁,两部法律产生了相似的效果。旧金山和华盛顿特区的法院各自只针对其中一项法律进行裁决。 Anthropic 方面表示,这是美国公司首次被同时依据这两部法律进行认定,这两部法律通常用于惩罚对国家安全构成风险的外国企业。

周三,由三名法官组成的上诉合议庭在描述这起案件为“史无前例”时写道:“批准暂缓令将迫使美国军方在重大军事冲突持续之际,继续与一家不受欢迎的关键人工智能服务供应商开展合作。”合议庭表示,尽管 Anthropic 可能因持续被认定为供应链风险而遭受经济损失,但他们不希望冒险“对军事行动造成重大的司法干预”,也不希望“轻易推翻”军方在国家安全问题上的判断。

旧金山的法官此前认定,国防部对 Anthropic 的行为可能出自恶意,其背后驱动是对这家 AI 公司提出技术使用限制以及公开批评这些限制的不满。上周,这位法官下令撤销供应链风险标签,特朗普政府随即遵从了这一裁决,恢复了对 Anthropic AI 工具在五角大楼及联邦政府其他部门的访问权限。

Anthropic 发言人 Danielle Cohen 表示,公司对华盛顿特区法院“认识到这些问题需要尽快解决”表示感激,并坚信“法院最终会认定这些供应链认定是非法的”。

国防部尚未立即回应置评请求,但代理司法部长 Todd Blanche 在 X 平台上发布了一份声明。他写道:“今天华盛顿特区巡回法院作出的暂缓令准许政府将 Anthropic 认定为供应链风险,这对军事战备而言是一场重大胜利。我们的立场从一开始就很明确——如果 Anthropic 的技术被整合到我们的敏感系统中,我们的军队需要完全访问其模型。军事指挥权和作战控制权属于总司令和战争部,而非一家科技公司。”

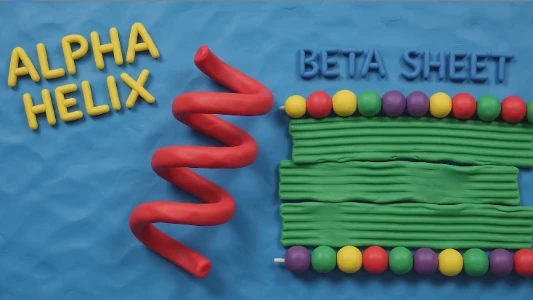

这些案件正在检验行政分支在科技公司行为方面拥有多大权力。 Anthropic 与特朗普政府之间的这场博弈同时也在五角大楼在针对伊朗的战争中使用 AI 的背景下展开。这家公司主张,自己是因为坚持其 AI 工具 Claude 缺乏某些敏感操作的准确性而受到非法惩罚,这些操作包括在没有人类监督的情况下执行致命无人机攻击等。

多位政府合同和企业权利方面的专家向知名科技媒体 WIRED 表示, Anthropic 对政府提起的诉讼有很强的胜算,但法院有时会拒绝在国家安全相关事务上否决白宫的决定。一些 AI 研究人员指出,五角大楼对 Anthropic 采取的行动“抑制了专业领域对 AI 系统性能问题的讨论”。

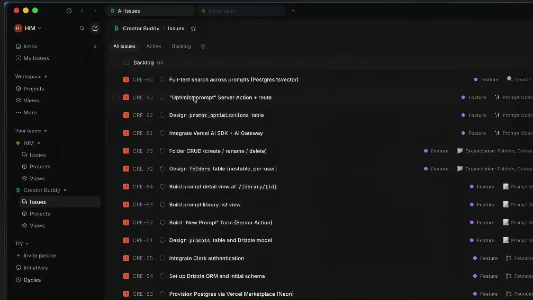

Anthropic 在诉讼中表示,因为这一认定而丢失了业务。政府律师则辩称,这一认定禁止五角大楼及其承包商将该公司的 Claude AI 用于军事项目。只要特朗普继续执政, Anthropic 可能无法重新获得其在联邦政府中曾经拥有的重要地位。

这两起诉讼的最终判决可能还需要数月时间。华盛顿特区的法院定于 5 月 19 日进行口头辩论。

目前双方披露的细节有限,尚未透露国防部具体如何使用 Claude ,或者其将员工过渡到谷歌 DeepMind 、 OpenAI 等其他公司 AI 工具的进展如何。在特朗普总统领导下已更名为战争部的军方表示,已采取措施确保 Anthropic 无法在过渡期间故意破坏其 AI 工具。