Google DeepMind 今日正式发布 Gemma 4 开源模型系列,宣称这是其迄今为止最强大的开源模型家族。该系列基于与 Gemini 3 相同的研究和技术架构打造,在参数效率方面实现重大突破,目前已可在 Hugging Face 、 Kaggle 和 Ollama 等平台下载使用。

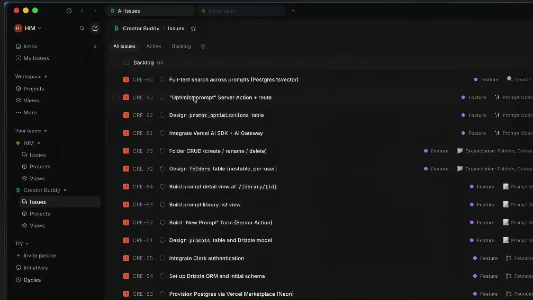

Gemma 4 提供四种规格以满足不同场景需求。 26B 和 31B 模型面向开发者工作站和高端消费级 GPU 优化,其中 31B Dense 模型在 Arena AI 文本排行榜上位列全球第三开源模型, 26B MoE 模型则专注于低延迟推理。 E2B 和 E4B 则针对移动端和物联网设备设计,完整支持离线运行和近零延迟处理,可部署于 Android 手机、 Raspberry Pi 及 NVIDIA Jetson Orin Nano 等设备。

技术能力方面, Gemma 4 在多项核心指标上实现显著提升。模型原生支持函数调用、结构化 JSON 输出和系统指令,能够驱动自主执行复杂工作流的智能体。大模型版本提供 256K 上下文窗口,可一次性处理完整代码仓库或长文档。视觉处理方面全系列支持可变分辨率图像和视频理解, E2B 和 E4B 额外内置音频输入能力。该系列已在超过 140 种语言上完成训练,覆盖全球主流市场。

开源策略上, Google 选择 Apache 2.0 许可证替代此前版本的部分限制条款,允许开发者完全控制数据处理、基础设施部署和模型定制,且支持商业用途无任何授权费用。这一决定被视为对开发者社区诉求的直接回应。

Google 同步推出 Gemma 4 Good Challenge 挑战赛,邀请开发者基于该模型构建具有积极社会影响力的应用产品。

Gemma 4 的发布标志着开源模型与闭源模型之间的性能差距进一步收窄。在行业标准评测中, 26B MoE 模型已能超越参数量达其 20 倍的竞品,这对于需要兼顾推理成本与模型能力的开发者而言具有实际意义。 Apache 2.0 许可的采用也可能重塑开源 AI 生态的商业化路径。