Google 澄清: Gemini 训练不涉及个人邮件,隐私安全机制全解析

Google 近日向用户明确表态, Gemini 智能体( AI Agent )的训练数据来源并不包含 Gmail 中的个人邮件内容。这一澄清回应了用户对 AI 模型升级可能带来的隐私风险的关切。

Google 解释称, Gmail 邮件数据受到多重隔离机制保护。用户内容不会与通用训练数据集混杂,模型优化主要依赖公开数据和合成数据。同时, Google 强调了数据最小化原则,用户仅在使用特定功能时,其相关内容才会被临时调用,且调用范围严格限定在完成具体任务的必要范围内。

从技术层面看, Google 采用了差分隐私、联邦学习和端到端加密等手段。即便 AI 系统需要处理邮件内容,也是在隔离环境中完成,原始数据不会被持久化存储或用于模型训练。

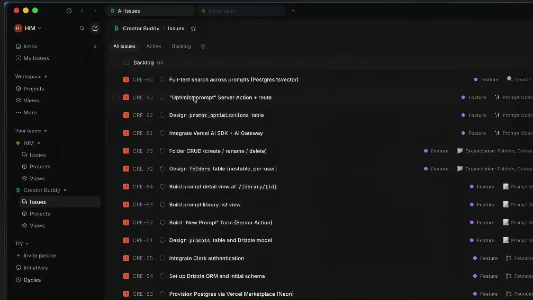

Gemini 在 Gmail 中的实际应用目前仅限于邮件摘要生成和回复建议等功能。这些功能由云端模型提供支持,但处理过程受到 Google Workspace 的安全协议约束,包括管理员控制台和审计日志等管理机制。

针对企业用户, Google Workspace 的默认配置已启用数据处理条款,意味着客户数据不会用于训练公开模型。企业管理员可通过控制台进一步细化权限设置,决定是否允许特定 AI 功能访问邮件数据。

隐私保护专家表示, Google 此次主动披露数据处理细节,反映出 AI 服务提供商在监管压力和用户信任危机下的策略调整。随着欧盟《人工智能法案》和各国数据保护法规的收紧,科技巨头在 AI 落地过程中必须更加审慎地平衡功能创新与隐私合规。

创艺洞察

值得关注的是, Gemini 在 Gmail 中的能力边界仍在持续扩展,从当前的辅助功能逐步向更复杂的任务执行演进。这种能力边界的扩张是否会在未来引发新的隐私争议,仍有待观察。