OpenAI 发布专用网络安全模型 强调现有防护措施已足够

OpenAI 于本周二公布了其网络安全战略的下一阶段规划,并同步推出了一款专为数字防御者设计的全新模型 GPT-5.4-Cyber 。

这一消息发布恰逢竞争对手 Anthropic 上周宣布将其 Claude Mythos Preview 模型暂不公开。据 Anthropic 方面表示,该模型存在被黑客和不法分子利用的风险。与此同时, Anthropic 还牵头成立了一个涵盖 Google 等行业竞争者的产业联盟,旨在探讨生成式 AI 领域的进展将对网络安全产生何种影响。

面对 Anthropic 的高调预警, OpenAI 显然有意在周二传递出截然不同的信息基调。这家 AI 巨头采用了更为克制的语气,一边强调其现有的安全护栏和防御机制,一边暗示长期来看的确需要更先进的防护手段。

OpenAI 在当天发布的博客文章中写道:“我们认为,当前所使用的安全防护级别已足以显著降低网络风险,支持现有模型的大规模部署。我们预计,这些防护措施的基本框架将同样适用于即将推出的更强能力模型。不过,对于那些专门针对网络安全工作进行训练并被设置为更高开放程度的模型,则需要更严格的部署控制和相应的管理机制。从长远来看,为确保 AI 安全在网络安全领域的持续有效性,我们还预见到未来模型需要更加全面的防御手段——届时这些模型的能力将快速超越当前最好的专用模型。”

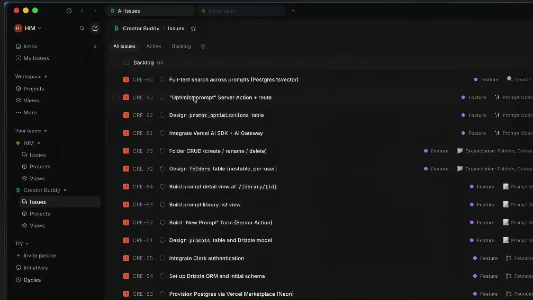

围绕网络安全战略, OpenAI 将重心锁定在三大支柱上。第一支柱涉及所谓的“了解你的客户”验证系统,旨在实现对新型模型的可控访问,同时尽可能扩大其“民主化”覆盖范围。 OpenAI 在博客中表示:“我们设计的机制旨在避免武断地决定谁能获得访问权限用于合法目的,谁不能。”该公司将针对特定组织进行有限发布与今年 2 月推出的自动化系统 Trusted Access for Cyber (简称 TAC )相结合。

第二支柱是“迭代部署”,即通过审慎的方式逐步释放新能力,让公司获得真实世界的反馈与洞察。博客特别强调了“对越狱攻击和其他对抗性攻击的抵御能力”以及“提升防御能力”两个重点方向。第三支柱则是投资布局,该公司表示这些投资将支持软件安全及其他数字防御领域,随着生成式 AI 的普及而持续发挥作用。

OpenAI 表示,这一系列举措是其更广泛安全努力的一部分。上个月启动的应用安全 AI 智能体 Codex Security 、 2023 年启动的网络安全资助计划、向 Linux Foundation 捐款支持开源安全项目,以及用于评估和防御前沿 AI 能力“严重伤害”的“准备框架”,均被纳入这一整体框架。

Anthropic 上周关于更强 AI 模型必将引发网络安全清算的主张,在安全专家群体中引发了争议。部分声音认为这一担忧言过其实,可能助长新一轮反黑客情绪,进一步巩固科技巨头的权力。另一些专家则强调,当前安全防御中已知的漏洞和不足确实存在,在智能体 AI 时代完全可能被更广泛的恶意行为者以全新速度和强度加以利用。