AI 正在撬动科技行业最具价值的资源

Nvidia 是 AI 芯片领域无可争议的王者,但由它一手推动的 AI 技术,或许很快将为这位冠军带来越来越多的竞争对手。

凭借现代 AI 对 Nvidia 设计方案的深度依赖,这家公司的市值已攀升至 4 万亿美元之上。每一次芯片迭代,都让企业得以在大型数据中心中调动数百乃至数千颗处理器协同工作,训练出更强大的 AI 模型。 Nvidia 成功的关键之一在于它提供了配套软件生态,帮助开发者驾驭每一代新芯片。然而,这项能力恐怕很快就不再是 Nvidia 独享的优势。

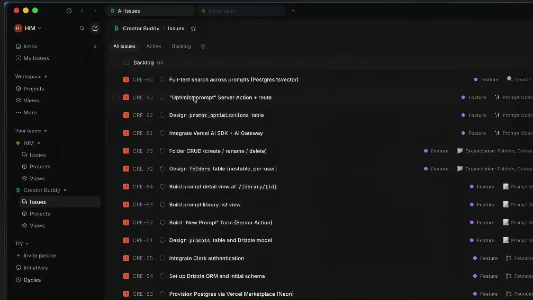

一家名为 Wafer 的初创公司正在训练 AI 模型,完成 AI 领域最难且最重要的任务之一:将代码进行优化,使其在特定硅芯片上尽可能高效运行。联合创始人兼 CEO Emilio Andere 介绍, Wafer 对开源模型进行强化学习训练,教会它们编写内核代码,即直接与操作系统硬件交互的软件。此外, Wafer 还为 Anthropic 的 Claude 和 OpenAI 的 GPT 等现有编程模型配备“智能体框架”,强化它们直接为芯片编写代码的能力。

如今,众多知名科技公司都已拥有自研芯片。苹果等企业多年来一直使用定制硅来提升笔记本电脑、平板和智能手机上软件的性能与能效。另一端, Google 和亚马逊也在生产自研芯片,以强化云平台的算力表现。 Meta 近期透露,将部署搭载与博通合作开发的新芯片、总量达 1 吉瓦的计算资源。使用定制硅意味着必须编写大量代码,确保软件在新处理器上流畅高效运行。

Wafer 目前正与 AMD 、亚马逊等公司合作,帮助优化软件以适配其硬件。该初创公司已从 Google 的 Jeff Dean 、 OpenAI 的 Wojciech Zaremba 等人处获得 400 万美元的种子轮融资。

Andere 认为, Wafer 的 AI 驱动方案有望挑战 Nvidia 的主导地位。当下不少高端芯片在原始浮点运算性能这一关键行业指标上,已经能够比肩 Nvidia 最强的产品。“AMD 最强的硬件、亚马逊 Trainium 硬件、 Google TPU ,在理论浮点算力上与 Nvidia GPU 处于同一水平,” Andere 表示,“我们要做的是最大化每瓦特电能所承载的智能密度。”

Andere 指出,能够胜任代码优化、使芯片可靠高效运行的性能工程师极为稀缺且价格高昂,而 Nvidia 的软件生态大幅降低了为其芯片编写和维护代码的门槛,这使得即便是最大的科技公司也难以单枪匹马与之抗衡。例如,当 Anthropic 与亚马逊合作、在 Trainium 芯片上构建 AI 模型时,不得不从零开始重写模型代码,以实现硬件上的最高运行效率。

Claude 如今已是编程能力超群的 AI 模型之一。 Andere 认为, AI 取代 Nvidia 的软件优势那一天或许并不遥远。“护城河存在于芯片的可编程性中,” Andere 指的是那些让开发者更轻松地为 Nvidia 硬件优化代码的函数库和软件工具,“我认为现在该重新审视这是否真的是一道难以逾越的护城河。”

除了让针对不同硅芯片的代码优化变得更加容易, AI 或许还将在芯片设计本身带来变革。由前 Google 工程师 Azalia Mirhoseini 和 Anna Goldie 创立的初创公司 Ricursive Intelligence ,正在开发用人工智能设计计算机芯片的全新方法。如果这项技术成熟,更多企业将能够切入芯片设计领域,打造运行自家软件更高效的定制硅。

“我们的目标是解决芯片设计中最耗时的环节——物理设计和设计验证,” Mirhoseini 表示。她同时也是斯坦福大学的助理教授,这两项工作正是芯片设计的主要挑战所在。设计计算机芯片是全球最具影响力、同时也最复杂的任务之一。芯片工程师需要在硅片上排列大量元件,以优化不同功能。芯片初步设计完成后,还需经过反复测试验证,迭代确认性能达标,才能将设计交付晶圆厂生产。

Mirhoseini 和 Goldie 在 Google 期间研发出一种 AI 优化计算机芯片关键元件布局的方法。这套方案革新了 Google 自研处理器的设计流程,如今已被业界广泛采用,协助在不同芯片上排列元件。

Ricursive 的野心不止于此。这家公司试图进一步自动化芯片设计的更多环节,并将大语言模型整合到流程之中。目标是让工程师能够用自然语言描述修改需求或提出问题。也许在不远的将来,工程师可以像“感觉式编程”一款应用那样,进行“感觉式设计”一枚芯片。

Ricursive 的技术仍在完善中,但 Mirhoseini 表示,公司已证明能够优化芯片设计的更多环节。这一前景令投资者垂涎: Ricursive 在短短数月内已完成 33.5 亿美元融资,估值达 40 亿美元。

Goldie 认为,终极目标或许是让 AI 同时参与芯片和算法的协同设计,实现更大程度的性能提升。 AI 自主优化硬件和代码的方式,将构成一种递归式的 AI 改进路径。“我们正在进入一个全新阶段,可以用更多算力来设计更快、更好的芯片——这就像是芯片设计领域的一条 scaling law 。”

创艺洞察

一个有趣的悖论正在浮现: Nvidia 凭借 CUDA 生态建立的软件壁垒,曾被视为这道护城河坚不可摧。但当 Claude 们的编程能力开始超越人类工程师,用 AI 攻克这道壁垒的逻辑已经自洽。这并非 Nvidia 的技术退步,而是 AI 进化到能够“理解”并“驾驭”复杂软件栈的标志性节点。可以预见,芯片领域的竞争将很快从硬件性能比拼,转向 AI 优化能力的较量。谁的 AI 能更懂硅,谁就能在算力经济中抢占先机。