OpenAI 扩展可信访问计划,数千名网络安全防御者将获得高级 AI 能力

OpenAI 于 4 月 14 日宣布,将其 Trusted Access for Cyber 计划从有限的试点阶段正式推向大规模应用阶段。根据官方信息,该项目现已向数千名经过验证的个人防御者开放,同时接纳了数百个负责保护关键软件的团队。此次扩展的核心在于引入分级访问机制,并通过身份认证与信任等级挂钩。

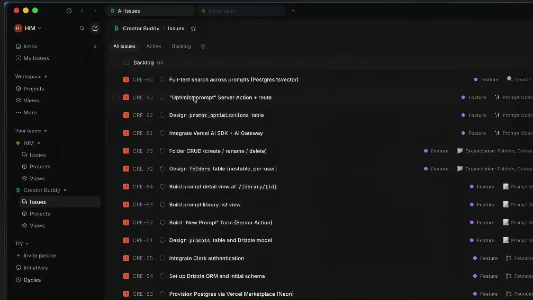

该计划的标志性产品是 GPT-5.4-Cyber ,这是 GPT-5.4 的专用微调版本,专为防御性网络安全任务打造。与标准版本相比,这一模型在安全相关任务上的能力限制显著减少,使分析师能够执行二进制逆向工程等专业工作,在缺乏源代码的情况下检测编译软件中的恶意代码、潜在漏洞及整体安全状况。个人用户可通过 ChatGPT 平台提交申请,企业用户则需通过 OpenAI 的销售渠道获取服务。最宽松的访问层级目前仅对经过审查的安全供应商、组织和研究人员开放。

OpenAI 的网络安全战略布局可追溯至 2023 年,当时该公司启动了网络安全资助计划。 2025 年 2 月, Trusted Access for Cyber 项目正式启动,与 GPT-5.3-Codex 同期发布, OpenAI 将网络工作定义为“双用途领域”,并建立了基于身份和信任的访问体系,以在保障合法防御者利益的同时维持对恶意使用的限制。今年 3 月, OpenAI 进一步推出 Codex Security ,这是一款应用安全智能体,能够映射项目上下文、在沙箱环境中验证可疑问题并提出修复方案。官方数据显示,该系统在其 beta 测试队列中扫描了超过 120 万次代码提交,识别了数百个关键问题和超过一万个高危发现,并已协助生态系统解决了三千多个关键及高危漏洞。

OpenAI 明确表示,该计划的受众并非普通消费者。项目的目标用户包括安全研究人员、防御工程团队、教育工作者、合规漏洞研究人员、开源软件维护者以及负责保护生产系统和关键基础设施的企业。 OpenAI 同时强调,在低可见性环境中,其是零数据保留设置和第三方平台,访问权限仍将保持更严格的限制,因为在这些环境中,公司对模型使用者和使用目的的洞察相对有限。 OpenAI 的立场是,随着模型能力在网络任务上的持续提升,防御性访问、验证、监控和部署控制必须同步扩展,而非等待某个预设阈值后才启动改革。

创艺洞察

OpenAI 将可信访问计划大规模化的背后逻辑,实际上是对“安全能力必须与责任机制同步扩展”这一理念的践行。在 AI 模型日益强大的当下,将防御者武装与将恶意使用者拒之门外之间存在天然的张力,而分级访问+MCP 的组合正在尝试给这道难题一个工程化的解法。值得关注的是其对“低可见性环境”的坦承。这种透明度本身,恰恰是建立行业信任的起点。