Meta 深化定制 AI 芯片布局,与 Broadcom 联合开发多代 MTIA

Meta 宣布扩大与芯片设计公司 Broadcom 的合作范围,双方将共同开发多代 MTIA ( Meta Training and Inference Accelerator )芯片,涵盖芯片设计、先进封装与网络互联技术。 Meta 披露,首阶段部署规模将突破 1 吉瓦容量上限,并在此后逐步扩展至数吉瓦级别,以支撑 Facebook 、 Instagram 、 WhatsApp 、 Messenger 及相关服务的 AI 产品与实时体验需求。

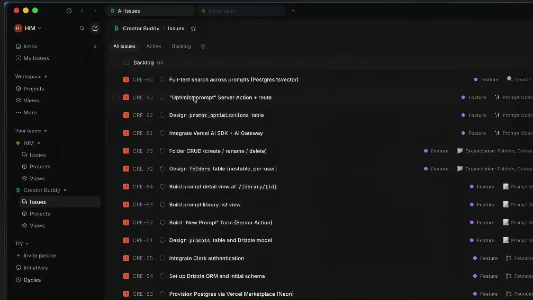

MTIA 定位为内部推理与推荐任务加速,而非面向外部市场。 Meta 已在数据中心部署数十万颗 MTIA 芯片,用于有机内容与广告推荐排序。今年三月, Meta 披露其路线图加速推进,计划在两年内推出四个新一代芯片,其中 MTIA 300 已进入量产阶段,专注于排序与推荐训练任务; MTIA 400 、 450 、 500 则将承担更广泛的工作负载,尤其针对 2027 年前的生成式 AI 推理场景。 Meta 认为,定制化硅芯片能够在特定任务上实现更高能效比,并降低整体拥有成本。

Broadcom 在这一合作中的角色远超单纯的代工伙伴。合作基于 Broadcom 的 XPU 平台构建, Broadcom 的以太网与集群网络技术则将用于连接 Meta 不断扩大的 AI 计算集群。 Broadcom 近期重点展示的技术矩阵包括 3.5D XDSiP 模块化 XPU 平台、 Tomahawk 6 交换芯片、用于超大规模 XPU 集群的 Jericho 4 互联结构,以及 800G AI 网卡方案,这些技术指向同一目标:以更高带宽与更低功耗构建更大规模的 AI 系统。此番合作意味着 Meta 正试图掌控从 CPU 、加速器到网络互联的完整底层栈,而不仅仅是模型开发本身。

这也使 Broadcom 深度嵌入 Meta 更宏大的基础设施战略。过去的两个月中, Meta 先后宣布与 NVIDIA 、 AMD 、 Arm 在 AI 基础设施领域的合作,同时将 MTIA 置于自身芯片战略的核心位置。这种组合模式意味着:在部分技术栈层级依赖外部伙伴,在 Meta 判断能够实现最高优化的特定工作负载上则采用自研芯片。值得注意的是, Broadcom CEO Hock Tan 将从 Meta 董事会离任,转而以战略顾问身份专注于 Meta 的芯片路线图,这一人事安排进一步凸显双方合作的战略深度。

创艺洞察

Meta 与 Broadcom 的这笔交易,本质上是一场关于“控制权”的押注。当行业普遍依赖通用的数据中心 GPU 时, Meta 选择了一条更重的路径,从芯片架构到网络拓扑全面自研。这不仅关乎成本与能效,更是在为未来的 AI 基础设施竞争构建底层壁垒。值得关注的是, Meta 同时维系着与 NVIDIA 、 AMD 、 Arm 的合作,这种“外部采购+内部定制”的双轨模式正在成为大型科技公司的标配,但能否真正形成差异化,仍然取决于自研芯片在实际部署中的表现。 Hock Tan 的角色转变或许是一个信号:芯片产业的游戏规则正在从“卖产品”走向“深度共谋”。