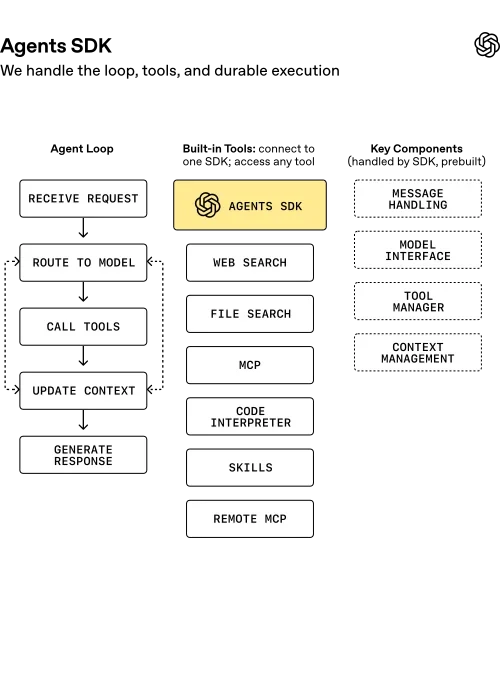

OpenAI 今日发布了 Agents SDK 的重大更新,为开发者提供了更强大的标准化基础设施,使其能够构建跨文件和工具工作的智能体,并在受控沙箱环境中处理长周期任务。

模型原生框架与沙箱执行

新版 Agents SDK 的核心升级在于引入了“模型原生框架”( model-native harness )。这一框架基于 OpenAI 模型的最优运行模式设计,使智能体能够更贴近模型本身的运作规律。实践中,这意味着复杂任务、尤其是需要跨多种工具和系统协调运行的长周期工作时,可靠性和性能都将得到显著提升。

框架现已内置多项实用原语:支持通过 MCP 进行工具调用、提供渐进式披露能力的 Skills 功能、可自定义指令的 AGENTS.md 文件、用于代码执行的 Shell 工具,以及用于文件编辑的 Apply Patch 工具。这套能力并非封闭系统,团队将持续引入新的智能体模式与原语,开发者因此可以将精力集中在让智能体产生实际价值的领域逻辑上,而非重复造轮子。

沙箱执行能力的整合是另一项关键更新。许多有实际价值的智能体需要读写文件、安装依赖、执行代码并安全调用工具,传统方案要求开发者自行拼凑这套执行环境。新版 SDK 通过内置的沙箱支持消除了这一门槛。目前已支持 Blaxel 、 Cloudflare 、 Daytona 、 E2B 、 Modal 、 Runloop 和 Vercel 等主流提供商。 SDK 还引入了 Manifest 抽象层,用于描述智能体的工作区配置,包括本地文件挂载、输出目录定义,以及与 AWS S3 、 Google Cloud Storage 、 Azure Blob Storage 和 Cloudflare R2 等存储服务的集成。

这一设计实现了从本地原型到生产部署的环境一致性迁移,同时为模型提供了一个可预期的工作空间:输入文件在哪里、输出结果写向何处、如何在长周期任务中保持工作有条不紊。

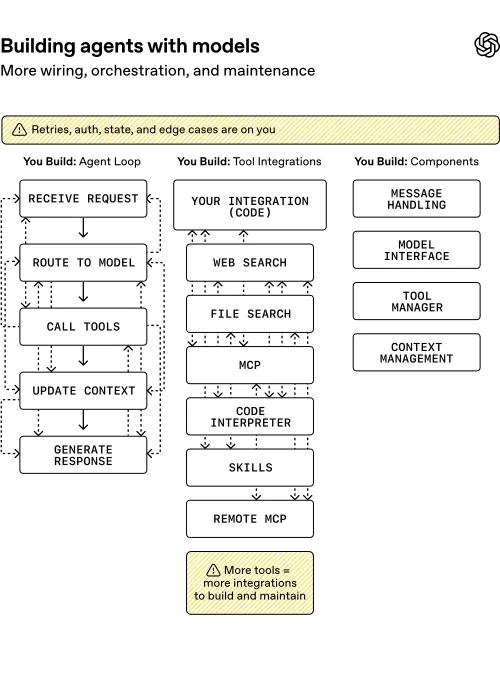

安全性、持久性与扩展性将框架层与计算层分离的设计决策在这套方案中扮演着核心角色。在模型生成的代码执行环境中,假设存在提示词注入和数据泄露威胁是审慎的安全假设。分离式架构可以将凭证隔离在代码执行环境之外,避免敏感信息暴露。这一架构还支撑了持久性执行能力。当智能体状态被外部化存储后,沙箱容器的丢失不会导致运行中断。 SDK 内置的快照与恢复机制允许在原有环境失败或过期时,在新容器中恢复智能体状态并从上一个检查点继续运行。在扩展性方面,智能体运行可以灵活配置:使用单个沙箱或多个沙箱、在需要时才调用沙箱、将子智能体路由至独立环境、在多个容器中并行化工作以加速执行。这些能力的组合使得整套方案能够适应从轻量原型到大规模生产部署的完整场景。企业验证与市场背景参与测试的企业已经验证了更新后的 SDK 在关键场景中的实际价值。 Oscar Health 的团队使用该 SDK 自动化了此前无法可靠处理的临床记录工作流。 Staff Engineer 兼 AI 技术负责人 Rachael Burns 表示,核心差异不仅在于提取正确的元数据,更在于能正确理解冗长复杂记录中每次就诊的边界。由此,团队能够更快把握每位患者在单次就诊中的情况,为会员提供更精准的照护需求支持和更优的服务体验。此外, LexisNexis 、 Thomson Reuters 、 Zoom 和 Tomoro AI 等企业也参与了测试。这一更新的实际背景在于:当前智能体开发领域存在明显的 tradeoff 。模型无关的框架虽然灵活,但无法充分利用前沿模型的能力;模型提供方的 SDK 更贴近模型运作,但框架层透明度不足;托管型智能体 API 简化了部署,却限制了智能体的运行位置及其对敏感数据的访问方式。新版 Agents SDK 试图在模型原生能力与开发者可见性之间找到更优的平衡点。

定价与可用性新版 Agents SDK 的能力现已向所有客户开放,通过 API 访问,计费采用标准 API 定价模式,基于 Token 用量和工具调用量计算。这些能力首发支持 Python , TypeScript 支持将在后续版本中推出。团队同时在推进代码模式( code mode )和子智能体( subagents )等高级能力的跨语言支持,并计划逐步扩大沙箱提供商的覆盖范围和集成生态。创艺洞察Agents SDK 的这次更新标志着 OpenAI 在智能体基础设施领域的战略意图进一步清晰。与其让开发者自行解决框架、沙箱、安全和扩展性等底层问题, OpenAI 选择将自身的工程能力封装为开箱即用的解决方案。对于企业而言,这一转变的价值在于降低了个性化基础设施的建设风险,同时保留了适配自身技术栈的灵活性。当框架层与计算层的分离成为行业实践的标准假设时,智能体系统的安全性和可靠性才能真正进入生产级讨论的范畴。