在人工智能(AI)技术迅猛发展的今天,我们已经见证了 AI 在文本、图像、音频和视频等领域的突破。然而,这些能力仍主要局限于数字世界。要让 AI 真正融入现实,它需要具备 “具身智能”(Embodied Intelligence) 。也就是说,AI 不仅要理解世界,还要能够在物理环境中做出合理的反应,并安全地执行各种任务。

Google DeepMind 正式推出了两款基于 Gemini 2.0 的全新 AI 模型,它们为下一代智能机器人奠定了基础。

Gemini Robotics:让 AI 具备行动能力

Gemini Robotics 是一款先进的视觉-语言-行动(Vision-Language-Action,VLA)模型,它在 Gemini 2.0 的基础上增加了物理行动能力,能够直接控制机器人。这意味着,AI 不再只是分析和理解世界,还能通过机器人与现实环境互动。

此外,Google DeepMind 还推出了 Gemini Robotics-ER,它进一步强化了 AI 的空间理解能力,使研究人员可以利用其 “具身推理”(Embodied Reasoning,ER)能力,自主开发机器人程序。这些突破让机器人能够完成比以往更广泛、更复杂的现实任务。

为了推动该技术的发展,Google 与 Apptronik 合作,共同研发新一代的人形机器人,并邀请一批可信赖的测试者参与 Gemini Robotics-ER 的试验,帮助探索其潜力。

AI 机器人需要具备哪些关键能力?

要让 AI 在现实世界中真正发挥作用,机器人必须具备以下三大核心能力:

1. 通用性(Generality)

机器人需要具备广泛的适应能力,能够在陌生环境中执行任务,而不依赖于提前编写的规则。Gemini Robotics 继承了 Gemini 模型的强大世界理解能力,能够在从未见过的环境中完成任务,并适应新的物品、指令和场景。

根据 Google DeepMind 的技术报告,相较于现有的视觉-语言-行动(VLA)模型,Gemini Robotics 在通用性测试中表现出色,整体性能提升了两倍以上。

2. 互动性(Interactivity)

现实世界是动态的,机器人必须能够实时响应人类的指令,并根据环境变化不断调整行为。

由于基于 Gemini 2.0,Gemini Robotics 具备强大的语言理解能力,不仅能理解自然语言(如日常对话),还能在与人类互动时快速做出反应。无论是家中还是工作场所,这种 “可调控性”(Steerability)都能让机器人更好地协同人类开展工作。

例如,如果机器人正抓取某个物体,而该物体突然滑落或被移动,Gemini Robotics 能够迅速调整计划,继续完成任务,而不会陷入“死机”状态。

3. 灵活性(Dexterity)

虽然人类可以轻松完成许多精细操作,例如折纸或将零食放入密封袋,但对于机器人而言,这类任务仍然极具挑战性。

然而,Gemini Robotics 具备极高的运动灵活性,能够执行复杂的多步骤任务,例如精确抓取、调整角度或稳定握持物体。这种能力使机器人可以胜任需要高精度操作的任务,例如医疗护理、仓储分拣或家务辅助等场景。

适配多种机器人平台

由于机器人形态各异,Gemini Robotics 也被设计为适应不同类型的机器人。

Google DeepMind 主要在双臂机器人平台 ALOHA 2 上训练该模型,但测试发现,它同样可以操控基于 Franka 机械臂的双臂系统(广泛用于学术研究),甚至还能适配更复杂的人形机器人 “阿波罗”(Apollo),帮助其完成现实世界中的任务。

Gemini Robotics-ER:强化 AI 的空间理解能力

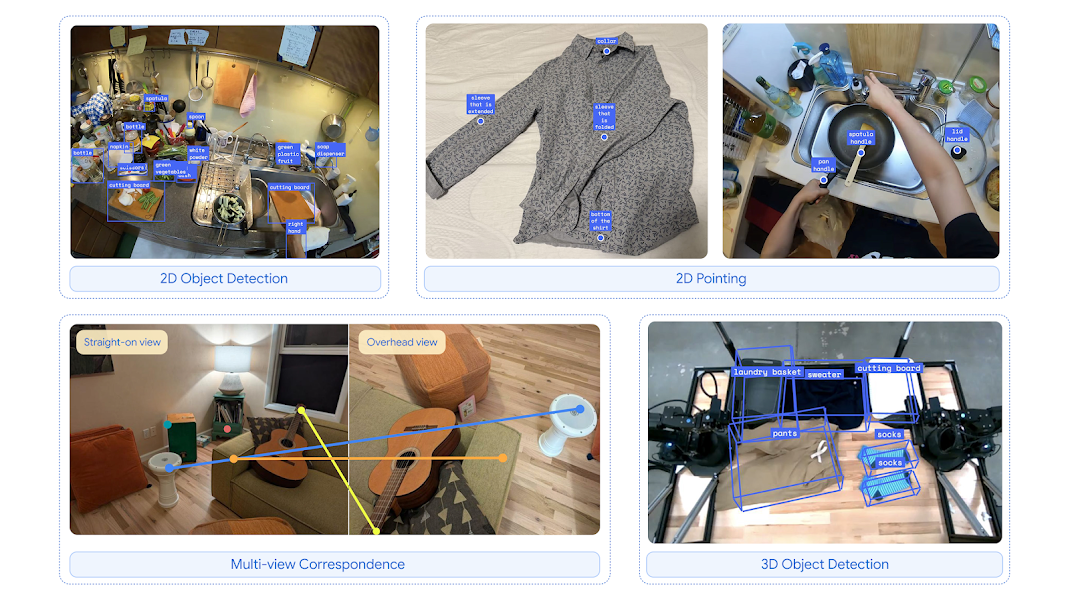

相比标准的 Gemini 2.0,Gemini Robotics-ER 具备更强的空间感知能力,能帮助机器人准确理解周围环境。例如,当它看到一个咖啡杯时,它不仅能识别该物品,还能推测最佳的抓取方式(如使用两个手指抓住杯柄),并规划安全的移动路径。

该模型能够端到端执行机器人控制任务,包括物体检测、环境感知、空间理解、路径规划和代码生成。在测试中,Gemini Robotics-ER 的任务成功率比 Gemini 2.0 提高了 2 到 3 倍,显著增强了 AI 机器人在现实世界中的适应能力。

此外,它还能通过 “上下文学习”(In-context Learning),仅凭少量人类示范,便能模仿并执行任务,提高任务完成率。

AI 机器人如何确保安全?

机器人进入现实世界后,安全问题至关重要。因此,Google DeepMind 采取了分层安全策略,确保 AI 机器人在执行任务时不会对环境或人类造成威胁。

在低层控制方面,他们采用了传统的机器人安全措施,如避免碰撞、控制接触力度、保持动态稳定性等。同时,Gemini Robotics-ER 还能与这些安全控制系统结合,确保机器人在执行任务时自动评估风险,避免做出危险动作。

此外,他们还发布了一套全新的机器人安全评估数据集(ASIMOV 数据集),用于衡量机器人在现实环境中的安全性。该数据集基于 Google DeepMind 之前的研究,参考了阿西莫夫(Isaac Asimov)提出的“机器人三定律”,并结合 AI 驱动的数据分析,帮助研究人员开发更加安全、符合人类价值观的机器人。

目前,Gemini Robotics-ER 已经开放给 Agile Robots、Agility Robotics、Boston Dynamics 和 Enchanted Tools 等机构的可信赖测试者。