要让大模型的回答更准确、更专业,目前主要有两种方法:RAG(检索增强生成) 和 模型微调(Fine-Tuning)。它们究竟是什么?有何区别?各自适用于哪些场景?AI 科普达人 New Machina 将在 5 分钟内,为大家深入解析这两项关键的 LLM 技术。

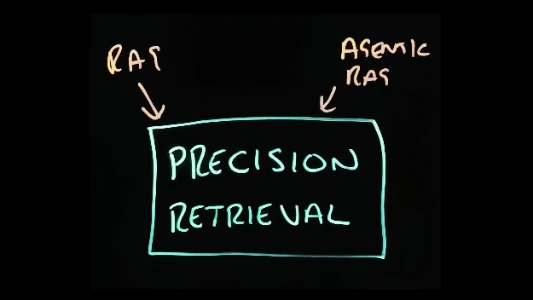

RAG 通过结合外部数据源(通常是向量数据库)来增强大语言模型的能力,使其能够实时获取最新信息,而无需修改模型本身。这种方法不仅成本更低,还能让系统保持动态更新,特别适合需要频繁获取新数据的应用场景。不过,RAG 依赖检索系统,数据质量和响应速度可能会受到影响。

相比之下,模型微调则是直接在特定领域的数据上进行训练,使模型在特定任务上的表现更精准、更专业。但微调过程需要大量计算资源,并且训练后的知识是静态的,无法获取新的信息,必须重新训练才能更新。

简单来说,RAG 更适用于需要实时信息的场景,而微调更适合专业领域的应用。如果追求准确性和专业化,模型微调是更好的选择。如果希望低成本、动态更新,RAG 则更具优势。