#视频生成

如何用一次性相机制作有趣的 AI 视频特效

Runway 新推创意教程:用一次性相机拍摄实拍素材,接入其AI视频工具自动生成趣味特效。无需专业设备或剪辑经验,普通人也能快速产出风格独特的短视频。

AI 科幻短片《欢迎来到阿特摩斯》及制作技巧分享

AI工作室the ALTERVERSE发布T2V科幻短片《欢迎来到阿特摩斯》,并详解海螺AI文生视频(T2V)创作方法:提出CEMA提示词结构(镜头/场景/动作/细节),分享一致性控制技巧与色彩分级实现路径,指出T2V在运动表现与画质上的独特优势。

AI 科普短片《镜像宏观世界》

AI科普短片《镜像宏观世界》巧妙避开AI在写实表现上的短板,转而聚焦于粒子、星体等不可见科学对象的可视化——用Midjourney绘图、Runway生成视频、Elevenlabs配音、Udio配乐,以虚构之形传递真实科学逻辑。

海螺 AI vs Runway Gen-3

海螺AI视频生成效果接近Runway Gen-3,目前完全免费开放,无需订阅即可体验高水准AI视频创作,适合预算有限但追求质量的创作者快速上手。

如何制作第一人称视角(FPV)40秒一镜到底 AI 视频

Pierrick Chevallier 用 Runway Gen-3 分三步生成40秒FPV一镜到底AI视频:从超市疾驰起步,经桥面延伸,最终抵达海滩。全程滑板车主体稳定、视角连贯,适合汽车追逐、奔跑等动态场景创作。

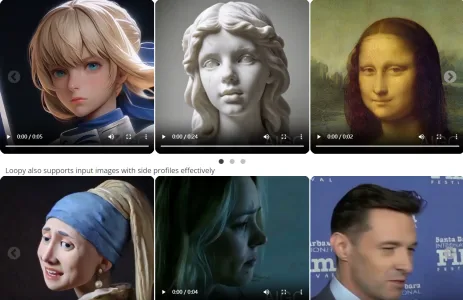

字节跳动与浙大联合开发 Loopy 模型,性能媲美阿里微软

字节跳动与浙大联合推出Loopy语音驱动肖像模型,仅需单张图像+音频即可生成自然口型、微表情及头部运动,支持照片/动漫/雕塑等多种风格与侧脸输入;其创新时序模块能建模长程运动规律,无需手动设定运动模板,效果媲美阿里EMO与微软VASA。

15分钟让你的 AI 图像栩栩如生

AI创作者Framer分享了一套15分钟搞定的AI动画工作流:用Midjourney定角色、实拍动作视频,再通过Viggle融合动作与形象,DomoAI以原图风格转绘强化一致性,最后去背合成至目标场景(如花卉生长视频),全程无需绿幕与动捕。

10 大主流 AI 视频工具测评

PixelWise测评10款主流AI视频工具,对比Runway、Pika等海外产品与快手可灵、Vidu、海螺AI等国产新锐,统一用提示词“Blogger showing off new graphics card”测试生成效果;结果显示部分国产工具已逼近Sora水平,实用性与创意表现俱佳。

9 个 Luma Dream Machine v1.6 运镜效果视频演示

Luma Dream Machine v1.6 新增镜头运动控制功能,仅需在提示词中加入 Pan、Push、Pull、Orbit、Crane 等关键词,即可精准生成平移、推进、拉远、环绕、吊臂升降等运镜效果。9 个实拍级演示视频直观呈现其对动态叙事与画面表现力的实质性提升。