“扮演专家(Act as an Expert)”已经是中阶操作了:2026 年提示词应该怎么写?

如果你写提示词还在用“你是一个XX专家”开头,那你大概停留在 2025 年的水平。不是说没用,而是 2026 年的高手已经不这么玩了。

Reddit 的提示词社区最近一条热帖:"Act as an Expert is a mid-tier strategy in 2026." 直接将这种经典提示词模板给“淘汰了”。贴主认为单人角色扮演只能让模型输出一个“和稀泥”的答案,因为它会本能地把冲突观点压平,给出一个四平八稳、谁都不得罪的回复。看起来专业,实际上什么硬核判断都没有。

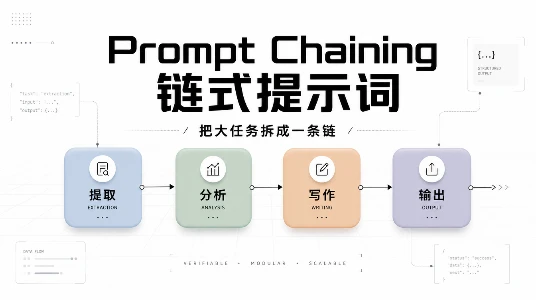

替代方案是什么

帖主给出了两个方向。

第一个方向叫“专家辩论面板(Expert Panel Simulation)”。不设一个"专家",设三个观点互相冲突的专家,让模型模拟一场辩论。比如你要评估一个技术方案的可行性,设定一个乐观派、一个悲观派、一个务实派,强制他们从各自立场发言,互相挑毛病。帖子里的核心观点是:单人角色会让模型压平冲突信息来讨好你,而三方辩论会把技术权衡硬生生逼出来。

这不是凭空发明。Sourcery.ai 的工程团队早在 2024 年就用 Panel-of-Experts 方法优化代码文档生成的质量,把错误率从 40% 降到可接受范围。他们的做法是把 "你是一个文档专家" 改成 "你是三个文档专家 Alice、Bob和Charles,通过讨论决定哪些内容需要更新",并在讨论结束后要求输出结构化 JSON。实测中发现一个关键细节:当 Alice 走上错误推理路径时,Bob 和 Charles 会主动纠正。这种自我纠错机制在单人角色扮演中根本不会触发。

Tweag 的 Agentic Coding Handbook 也收录了 Three Experts Method,把它列为编程Agent的推荐推理模式,专门用于处理复杂架构决策。GitHub上甚至有人给 Claude Code 写了 debate skill,直接让 Agent 开内部辩论会。

第二个方向叫“压缩协议(Compression Protocol)”。长提示词的典型问题是:你写了 2000 字的背景信息,模型只关注最后出现的那几段,前面的几乎被忽略。压缩协议的做法是把核心约束压缩成高密度短句,放在每次交互的固定位置,确保模型每次都能看到。不是写得更长,是写得更短更狠。

这两招为什么比 "扮演专家" 高级?因为它们解决的是同一个根本问题:模型倾向于给出最安全、最泛化的答案。单人专家设定没有改变这个倾向,只是换了个壳。辩论面板用冲突机制强制模型暴露技术权衡,压缩协议用信息密度强制模型关注核心约束。两种方法都在从结构上改造模型的行为模式,而不只是改写措辞。

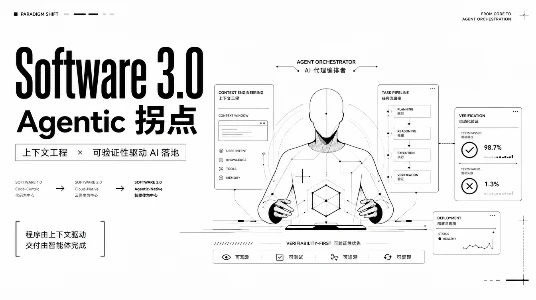

Reddit另一条热帖从不同角度验证了这件事。帖主说自己用了 ReAct 循环(Reason + Act)之后,AI 的准确性 "跳了级"。ReAct 的思路是:模型先输出Thought(我在想什么),再输出Action(我要调什么工具),拿到 Observation(工具返回了什么),三段循环往复。Mick Delaney 在专门分析 ReAct 循环的文章里说得很透:模型本身是无状态的,每次调用都是全新推理,所谓的 "记忆" 其实是你的代码维护的对话日志。这意味着真正的优化点不在提示词措辞,而在你如何设计循环的结构、如何管理对话状态、如何让模型在每一步都有足够的信息做决策。

这跟 Pere Villega 那篇广为传播的文章呼应上了。他说你精心写的 200 Token 提示词只占模型百万 Token 上下文窗口的 0.02%,剩下 99.98% 全是上下文环境。他提出了四层框架:提示词手艺(写清楚指令)、上下文工程(设计模型看到什么)、意图工程(编码目标和边界)、规格工程(让组织知识变成Agent可执行的蓝图)。大多数人在优化第一层,实际问题在第二到四层。

Reddit 还有条帖子把话说得更狠:"写提示词是基础设施,不是用户技能(Prompt engineering as infrastructure, not a user skill.)" 。这意味着提示词应该像 CI/CD 管道一样被版本管理、被测试、被自动化,而不是靠个人手写然后祈祷效果好。

说回实操。如果你想试试 Expert Panel Simulation,最简单的起步方式是这样:把你的提示词从"你是一个资深架构师" 改成 "你是三个架构师,分别代表性能优先派、安全优先派和成本优先派,针对以下技术方案展开5分钟辩论,最后给出一个包含三方观点的总结和推荐"。写完你会发现,输出的深度和细节比单人角色多出一个量级。因为你不再是让模型 "表演专业",而是让不同立场真正碰撞。

压缩协议的起步更简单:把你提示词里最关键的三条约束拎出来,压缩成每条不超过 15 个字的短句,放在系统提示词的头部和用户消息的尾部各放一次。不是写更多,是让最核心的信息在模型最容易关注的位置出现两次。